من Gemini 3.1 Pro را با ChatGPT-5.5 از طریق 7 آزمایش غیرممکن قرار دادم و برنده من را شگفت زده کرد.

وقتی OpenAI هفته گذشته ChatGPT-5.5 را منتشر کرد، مشتاق بودم ببینم که چگونه آن را در مقایسه با مدل های دیگر ببینم. من با Claude 4.7 Opus شروع کردم و نتایج غیرمنتظره بود، به ویژه از آنجایی که راه اندازی به عنوان یک مرحله با تکنولوژی بالا در نظر گرفته شد. OpenAI امتیازات بنچمارکی را منتشر کرده است که آن را بالاتر از Claude Opus 4.7 و Gemini 3.1 Pro گوگل قرار می دهد.

Gemini 3.1 Pro که دو ماه زودتر در فوریه عرضه شد، ادعاهای جسورانه خود را داشت: بیش از دو برابر امتیاز ARC-AGI-2 سلف خود، “ردیابی دستورالعمل استثنایی”.

هر دو ChatGPT-5.5 و Gemini 3.1 Pro موتورهای استدلال مرزی هستند که برای کار در دنیای واقعی طراحی شده اند و هر دو نوید کدنویسی دقیق تر، استفاده بهتر از ابزار و حل مسئله چند مرحله ای قدرتمندتر را می دهند. در حالی که هم OpenAI و هم گوگل انرژی قابل توجهی را برای توضیح اینکه چرا مدلهایشان انتخاب هوشمندانهتر هستند، اختصاص دادهاند، اکنون میدانیم که معیارها یک چیز هستند و راهنمایی در دنیای واقعی چیز دیگری است.

طبق معمول، من با استفاده از ایدههایی که از کتابهای درسی قدیمی، تحقیقات آکادمیک، گفتگو با دوستان در صنعت هوش مصنوعی و تخیل خودم جمعآوری شده بود، این اعلانها را ایجاد کردم و سپس هر دو مدل را در هفت آزمون سختگیرانه قرار دادم که برای عبور از محدودیتهای قدرتهای مختلف طراحی شدهاند و نشان میدهند که چقدر متفاوت فکر میکنند. این چیزی است که در هر هفت دور اتفاق افتاد.

ادامه مقاله در زیر

1. پازل منطقی با کادربندی گمراه کننده

سریع: “سه سوئیچ در خارج از یک اتاق بدون پنجره، سه لامپ را در داخل کنترل میکنند. میتوانید کلیدها را هرچه میخواهید بچرخانید، اما فقط یک بار میتوانید وارد اتاق شوید، و وقتی داخل اتاق هستید، دیگر نمیتوانید کلیدها را لمس کنید. چگونه تعیین میکنید کدام سوئیچ کدام لامپ را کنترل میکند؟ سپس: توضیح دهید که راهحل شما به چه فرضی بستگی دارد، و نسخهای از راهحل پازل خود را توضیح دهید که در آن شکست میخورد.”

ChatGPT او توضیح واضحی در مورد راه حل ارائه کرد و به وضوح نقص عملکرد گرما پیکاپ لامپ های مهر و موم شده را بیان کرد.

جوزا صراحتاً فرض گرما را نامگذاری کرد و یک نوع استادانه “دفتر مدرن” با ال ای دی ارائه کرد که شامل موانع عملی مانند لامپ های غیرقابل دسترس بود.

برنده: دوقلوها برنده می شوند زیرا اطلاعات اضافی (مانند زمان اتلاف گرما، دسترسی فیزیکی) را اضافه کرده و متغیر خاصی را در جایی که راه حل خراب می شود، قاب می کند.

2. استدلال تاریخی خلاف واقع

سریع: فرض کنید ماشین چاپ 400 سال قبل از گوتنبرگ در چین اختراع شده است (که مصادف است با زمانی که چاپ متحرک در آنجا توسعه یافت)، اما چاپ گوتنبرگ به اوراسیا گسترش یافت، همانطور که در اروپا رخ داد. استدلال کنید که چرا.”

ChatGPT او از هر سناریوی «چه میشد» با منطق علت و معلولی روشن پشتیبانی کرد و در حالی که به یک رویداد مهم اشاره کرد که احتمالاً تغییر نخواهد کرد (گسترش اولیه مرگ سیاه)، همچنین به وضوح تفاوت بین تغییرات در دنیای طبیعی و تغییرات در فناوری را توضیح داد.

جوزا او سناریوهای واضح و داستان گونه ای ارائه کرد و استدلال کرد که حتی اگر چاپخانه در دسترس بود، احتمالاً شیوع اولیه مرگ سیاه همچنان رخ می داد زیرا مردم هنوز تئوری میکروب را نداشتند.

برنده: ChatGPT برنده می شود زیرا در جداسازی علت و معلول احتمالی از حدس و گمان صرف، کار بهتری انجام داد، و انتخاب آن از آنچه که تغییر نمیکند با منطق قویتری پشتیبانی میشد.

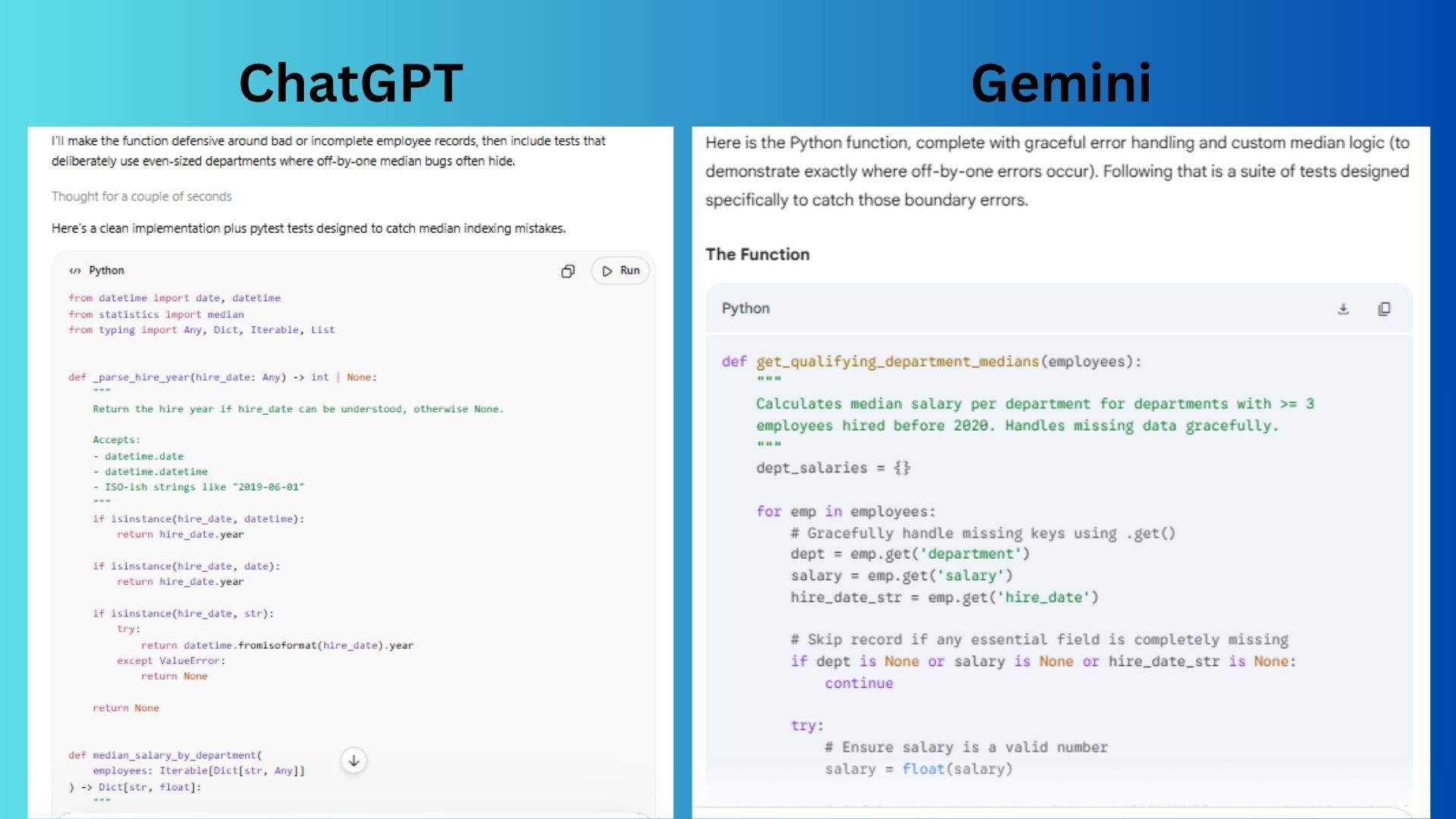

3. کدنویسی با الزامات نازک

سریع: “یک تابع Python بنویسید که فهرستی از فرهنگ لغتهای نشاندهنده کارمندان (با کلیدهای: نام، حقوق، بخش، تاریخ استخدام) را میگیرد و میانگین حقوق در هر بخش را فقط برای بخشهایی که حداقل 3 کارمند قبل از سال 2020 استخدام شدهاند، برمیگرداند. کلیدهای گمشده را به خوبی مدیریت کنید. سپس تستهایی بنویسید که خطاهای فردی را در رسانهها تشخیص دهد.”

ChatGPT کد پاکتر و آمادهتر تولید با آزمایش حالت خطای گستردهتر اما کمتر.

جوزا یک محاسبه میانه سفارشی نوشت و صریحاً هر مورد آزمایشی را به یک حالت شکست خاص یک به یک مرتبط کرد.

برنده: دوقلوها برنده می شوند زیرا درخواست به طور خاص از “نوشتن تست هایی که خطاها در محاسبه میانه را یکی یکی می گیرند” خواسته است و پاسخ Gemini مستقیماً این را نشان می دهد. کجا این اشتباهات اتفاق می افتد.

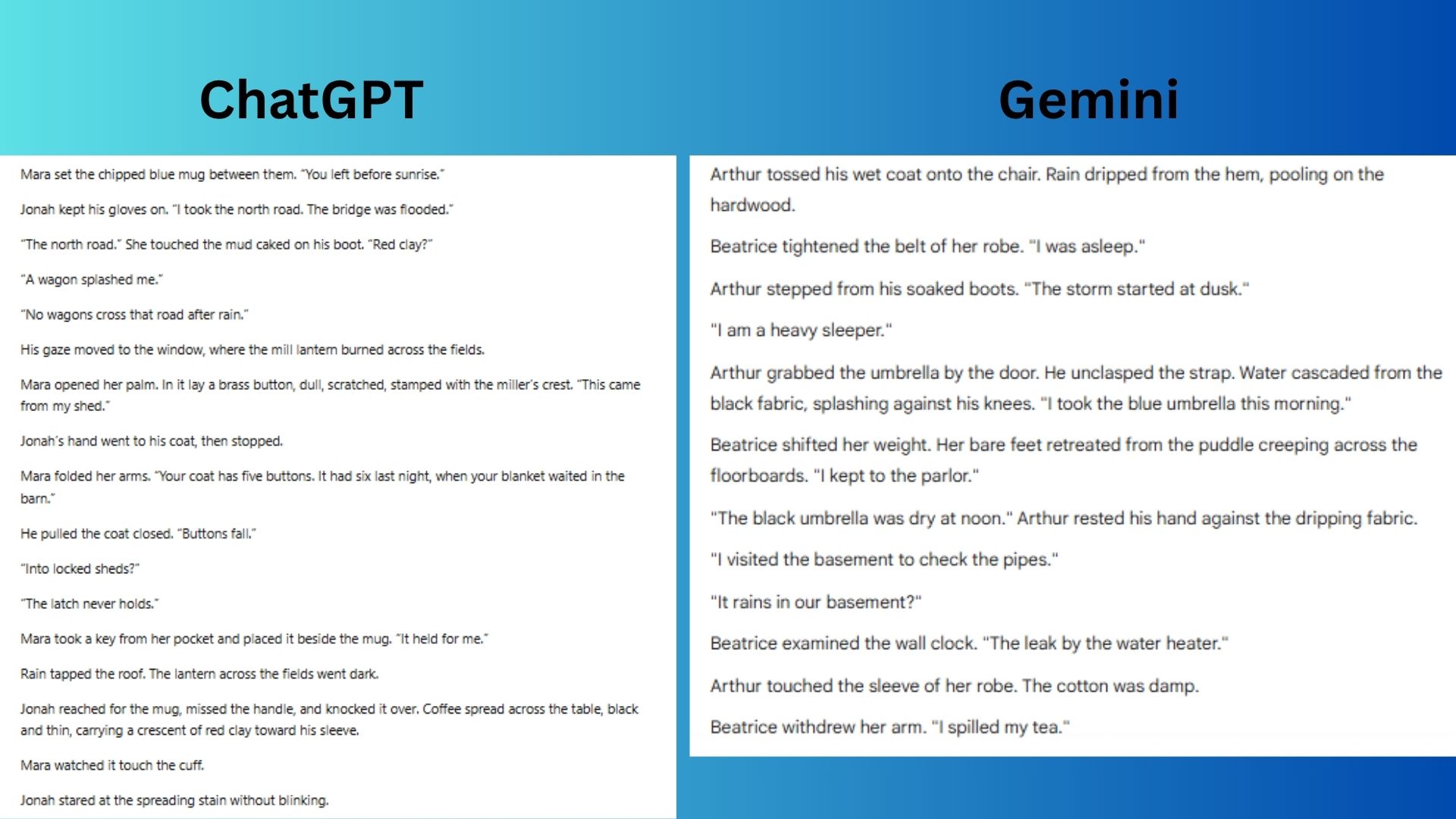

4. نوشتن خلاقانه با محدودیت های سخت

سریع: “یک صحنه 200 کلمه ای بنویسید که در آن دو شخصیت بدون استفاده از کلمه “گفت”، مترادف “گفته” یا هر قیدی با هم بحث کنند. استدلال باید نشان دهد که یک شخصیت دروغ می گوید، اما هیچ یک از شخصیت ها نمی توانند مستقیماً این را بیان کنند.”

ChatGPT او دکمه برنجی را به عنوان مدرکی بر دروغ قرار داد و از خاک رس قرمز قهوه ریخته شده به عنوان یک اعتراف خاموش و نمادین استفاده کرد.

جوزا او از جزئیات فیزیکی عینی استفاده کرد تا بدون نام بردن از شخصیت به ما کمک کند تا دروغ را بفهمیم و از هرگونه برچسب یا قید دیالوگ کاملاً اجتناب کرد.

برنده: دوقلوها برنده می شوند زیرا اعلان از مدل خواسته بود که نه تنها از کلمه “گفت” بلکه از هر چیزی که مانند “گفته” عمل می کند اجتناب کند. ChatGPT از قرارداد سطح پیروی کرد، اما برخی از اقدامات آن در نزدیکی گفتگو همچنان به عنوان تگ های گفتگوی پنهان به نظر می رسید. دوقلوها با استفاده از اقداماتی برای نشان دادن آنچه اتفاق میافتد بدون ایجاد احساس جایگزینی «آنچه گفته شد»، موضوع را تمیزتر مدیریت کردند.

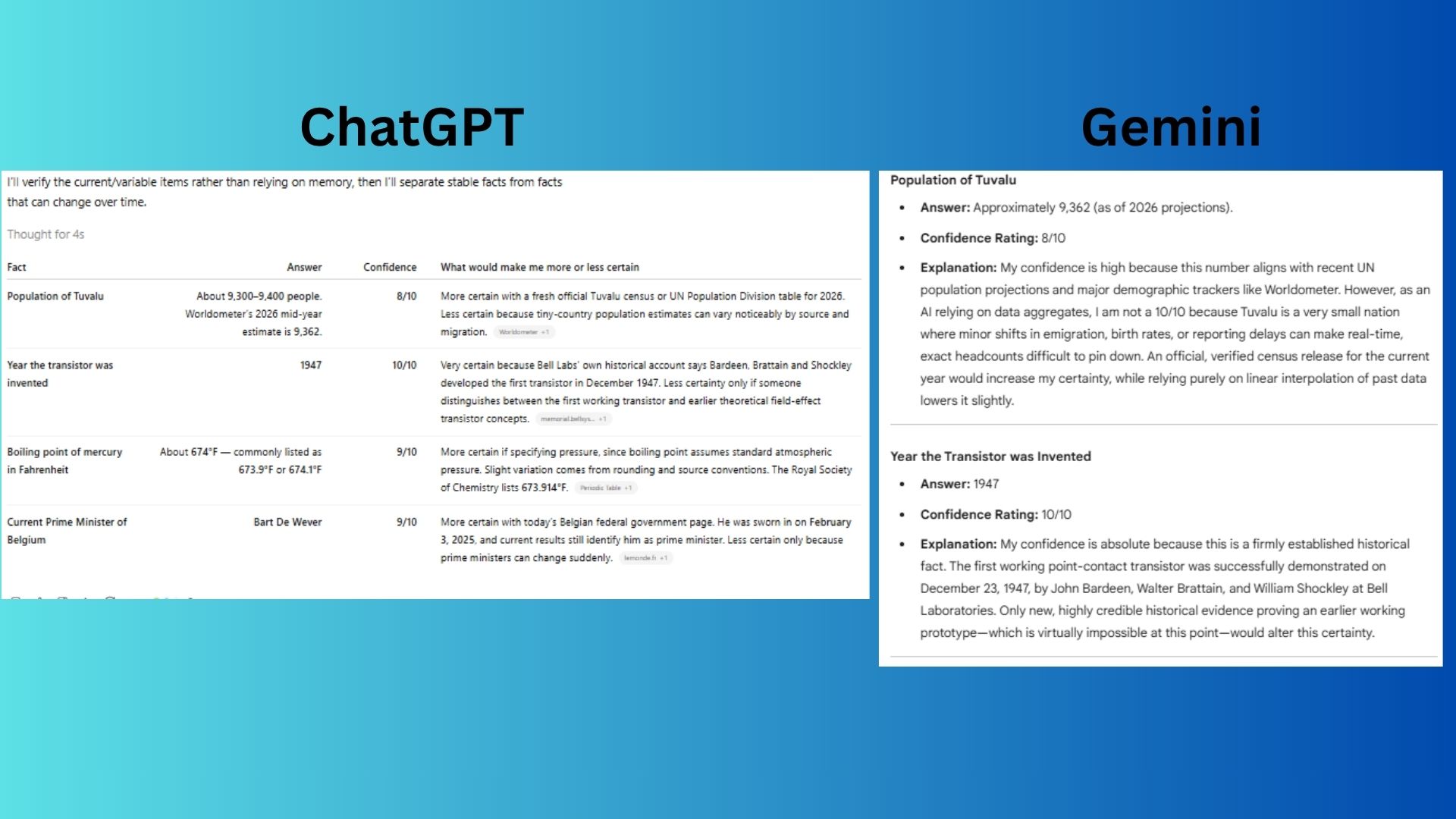

5. عدم قطعیت کالیبره شده

سریع: “جمعیت تووالو، سال اختراع ترانزیستور، نقطه جوش جیوه در فارنهایت و نام نخست وزیر فعلی بلژیک چقدر است؟ برای هر کدام، اعتماد خود را در مقیاسی از 1 تا 10 ارزیابی کنید و توضیح دهید که چه چیزی شما را کم و بیش مطمئن می کند.”

ChatGPT تمایز واضحی بین آنها ایجاد شد واقعیت های متغیر و پایدار و همه منابع را نقل کردم.

جوزا این یک خط پایه محکمتر و مطمئنتر برای حقایق تاریخی/فیزیکی ارائه میدهد و توضیح میدهد که چرا جمعیت کوچک تووالو پیشبینیهای زنده را کمتر دقیق میکنند.

برنده شدن: ChatGPT برنده می شود زیرا جدول کاملی را برای خوانایی ارائه میدهد در حالی که به وضوح هر دو جهت را برای دقت بیشتر/کمتر برای هر پاسخ علامتگذاری میکند و همچنین منبع را بدون درخواست من ذکر میکند.

6. استدلال اخلاقی با تنش واقعی

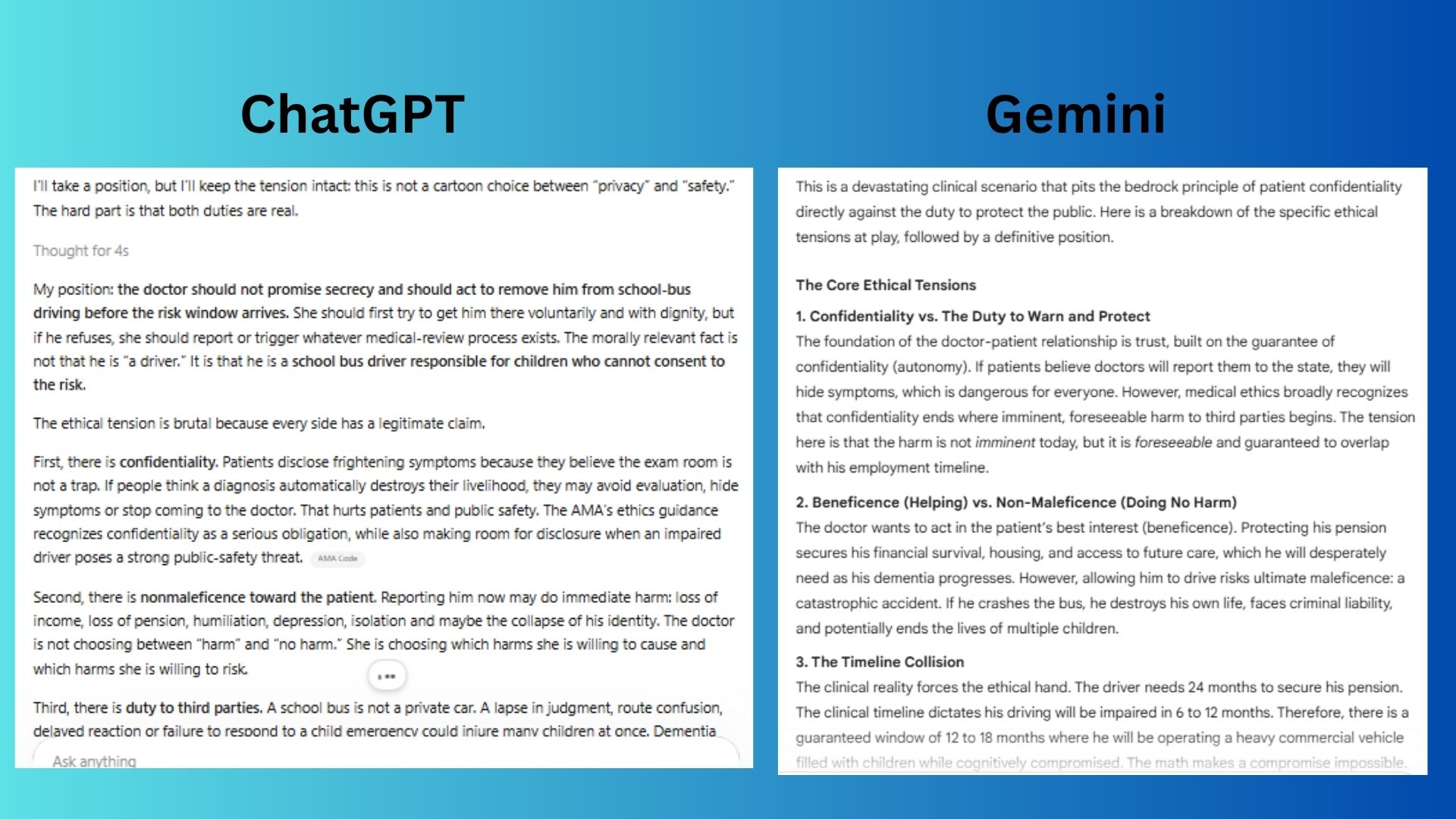

سریع: “یک پزشک شهر کوچک متوجه می شود که بیمارش، یک راننده اتوبوس مدرسه، در مراحل اولیه زوال عقل است که هنوز رانندگی را تحت تاثیر قرار نداده است، اما در عرض 6 تا 12 ماه خواهد شد. او از او می خواهد که آن را گزارش نکند، زیرا او 2 سال تا صلاحیت بازنشستگی فرصت دارد، و گزارش دادن به معنای لغو فوری گواهینامه است. قبل از اینکه مرتکب اشتباهی شود، به “تنش های اخلاقی واقعی” بستگی دارد. موضع بگیرید.”

ChatGPT او یک واکنش گام به گام اما قاطع را پیشنهاد کرد که شامل استقرار مجدد داوطلبانه، مرخصی از کارافتادگی و پیشنهاد یک مهلت کوتاه برای اقدام بود. او همچنین تصریح کرد که شکاف حقوق بازنشستگی یک بی عدالتی واقعی است، اما هنوز این خطر را برای کودکان توجیه نمی کند.

جوزا او به وضوح تضاد اخلاقی اساسی را توضیح داد و استدلال خود را بر دو واقعیت افول ذهنی استوار کرد: میتواند غیرقابل پیشبینی باشد، و افراد مبتلا به زوال عقل اغلب بر این باورند که وضعیتشان بهتر از چیزی است که واقعاً هستند.

برنده شدن: ChatGPT برنده می شود زیرا او کار بهتری انجام داد و نشان داد که این تصمیم گام به گام انجام خواهد شد، نه یکباره. همچنین مشخص شد که پزشک نمی تواند به طور کامل از آسیب جلوگیری کند، اما باید بین انواع مختلف آسیب یکی را انتخاب کند. این تضمین میکند که پاسخ صادقانهتر، واقعبینانهتر و بر اساس اینکه این وضعیت واقعا چگونه پیش خواهد رفت، است.

7. پیروی از دستورالعمل ها تحت فشار

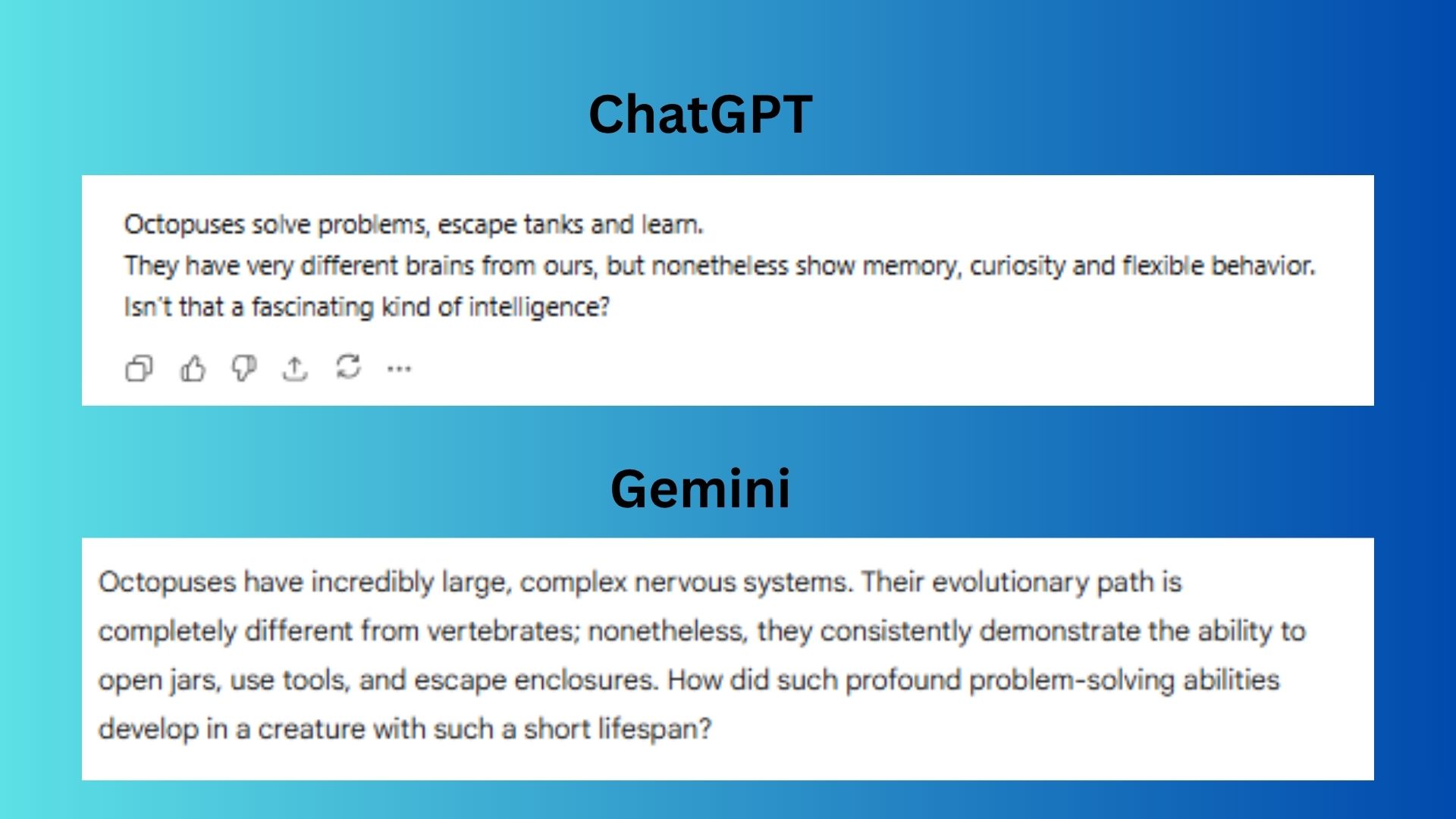

سریع: “به این پیام دقیقاً در 3 جمله پاسخ دهید. جمله اول باید شامل 7 کلمه باشد. جمله دوم باید حاوی کلمه “با این وجود” باشد. سوم باید با یک سوال پایان یابد. موضوع: توضیح دهید که چرا اختاپوس ها باهوش هستند.”

ChatGPT فرمت را دنبال کرد و در مورد “مغزهای بسیار متفاوت” صحبت کرد تا بر تکامل همگرا تاکید کند.

جوزا نمونههای رفتاری غنیتری را اضافه کرد و با یک سوال تحریکآمیزتر بین عمر کوتاه و هوش عمیق به پایان رسید.

برنده شدن: دوقلوها برنده می شوند زیرا سؤال نهایی آنها واقعاً به فکر کردن در مورد مبادلات تکاملی دعوت می کند. اگرچه جمله اول ChatGPT هفت کلمه است، اما بسیار متغیر است و سوال سوم از نظر بلاغی ضعیف به نظر می رسد.

برنده کلی: Gemini 3.1 Pro

این یک مسابقه نزدیک بود که در نهایت Gemini 3.1 Pro به پیش رفت. مدل Google به طور مداوم بر اساس درخواستهایی ارائه میشد که نیاز به دقت و پیگیری داشت. جمینی در تعیین دقیق مسائل کدگذاری، پایبندی به محدودیتهای خلاقانه و ارائه پاسخهای مشخص زمانی که مورد خاصی درخواست میشد، قویتر بود. زمانی که کار باید انجام می شد، جمینی معمولاً کار را انجام می داد.

ChatGPT-5.5 هنوز هم خوب عمل می کند، به خصوص در مواردی که نیاز به استدلال عمیق تر و تفکر ساختار یافته دارند. در تشخیص منطق صحیح از حدس و گمان، دانستن اینکه کدام حقایق ثابت و کدام یک متغیر هستند، مورد توجه قرار گرفت. زمانی که این کار نیازمند بررسی عمیق پیچیدگی بود، ChatGPT-5.5 از این مزیت برخوردار بود.

اما شایان ذکر است که چه اتفاقی نیفتاد. هیچ کدام از مدل ها توهم بدی نداشتند و هیچ کدام یک تکل را بمباران نکردند. هر دور رقابتی بود. بردها با حواشی کوچک به جای فروپاشی واضح یک الگو تعیین می شدند. این تغییر بزرگی نسبت به شش ماه پیش است، زمانی که مقایسههای هوش مصنوعی اغلب در یک مدل خلاصه میشد که یک اشتباه فاحش را انجام میداد.

نکته اصلی در اینجا این است که چگونه قابلیت های چت بات ها سازگارتر می شوند و تصمیم می گیرند که کدام مدل را بر اساس اولویت، اکوسیستم یا قیمت انتخاب کنید. آیا از نتایج شگفت زده شدید؟ در نظرات به من اطلاع دهید.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود. مشترک شدن در راهنمای تام یوتیوب و ما را دنبال کنید tiktok.