OpenAI پس از واکنش شدید، MLK را از Sora حذف کرد – این به معنای هوش مصنوعی و هویت است.

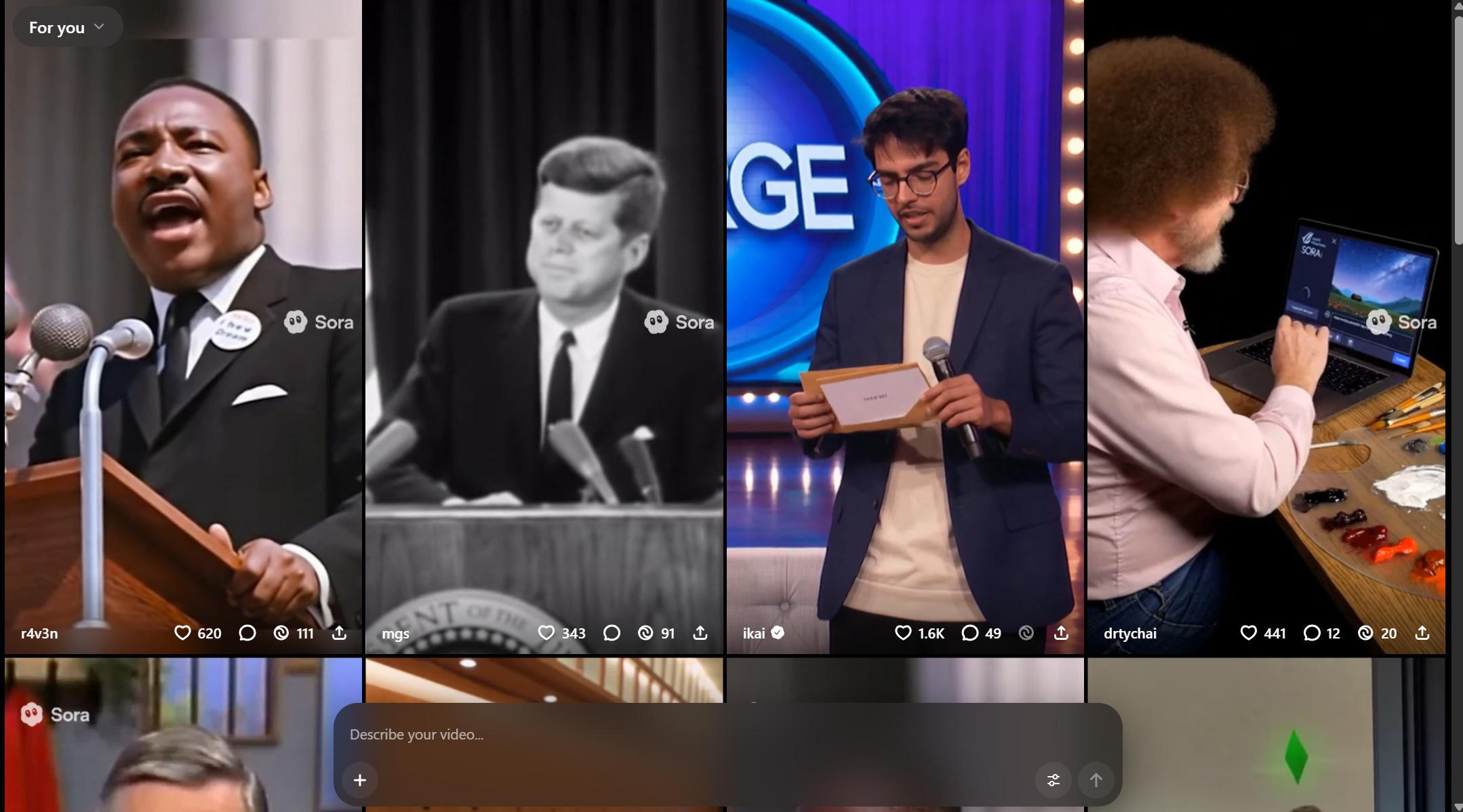

OpenAI امروز اعلام کرد که ویدیوهای تولید شده توسط هوش مصنوعی مارتین لوتر کینگ جونیور را در برنامه Sora خود پس از انتقاد شدید به دلیل محتوای دیپفیک «بیاحترامی» با نماد حقوق مدنی متوقف میکند.

ویدیوهای MLK Jr. شامل همه چیز است، از رویاپردازی در مورد کوکیهای شکلاتی و سم آلتمن گرفته تا فرزندان بسیار شوم ویدیویی.

در حالی که این حرکت به عنوان امتیازی برای میراث کینگ در نظر گرفته شده است، اما به تنشهای عمیقتر در مورد نحوه هدایت پلتفرمهای هوش مصنوعی در تاریخ، رضایت و اخلاقیات احیای شخصیتهای عمومی اشاره میکند. مایکل جکسون، کوبی برایانت و جی اف کی از جمله ویدیوهای در حال مرگ و توهین آمیزی هستند که در حال حاضر در حال پخش هستند.

OpenAI در حال عقب نشینی است

OpenAI همان کاری را انجام میدهد که باید همیشه انجام میداد: اجازه نمیداد از چهرههای عمومی درگذشته در ویدیوهای تولید شده توسط هوش مصنوعی استفاده شود. از زمانی که Sora منتشر شد، کاربران از دکتر این سوال میپرسیدند که ویدئوهای هوش مصنوعی حاوی تحریفهای تکاندهنده از کینگ و سایر چهرههای برجسته، از جمله تصاویری که خانواده و حامیان او توهینآمیز و تحقیرآمیز توصیف کردهاند، منتشر کرده است.

برنیس آ. کینگ، دختر مارتین لوتر کینگ جونیور، خواستار توقف ویدیوهای ایجاد شده عمومی در اینستاگرام شد، که باعث شد بیانیه مشترکی با OpenAI درباره نردههای محافظ قویتر و مکانیسمهای انصراف برای املاک صادر شود.

OpenAI این تصمیم را به عنوان متعادل کردن آزادی بیان با احترام به میراث و کنترل تعریف کرد: این شرکت گفت که شخصیتهای عمومی (و خانوادههای آنها) باید در مورد نحوه استفاده از شباهتهایشان در رسانههای هوش مصنوعی نظر داشته باشند.

مرز وحشی هوش مصنوعی

ابزارهای هوش مصنوعی مانند Sora به کاربران این امکان را می دهد که نمادهای فرهنگی قدیمی را تصور کنند یا از آنها تقلید کنند، اما اخلاق انجام این کار به سرعت مبهم می شود. آیا این ادای احترام، طنز یا بی احترامی است؟ مکث نشان می دهد که این بحث چقدر خام و حل نشده است.

حتی قبل از انتشار Sora 2، در طی یک جلسه توجیهی با OpenAI که شامل سم آلتمن میشد، من و سایر روزنامهنگاران احتمالات منفی ارائه چنین ابزارهای قدرتمند هوش مصنوعی به کاربران را زیر سوال بردیم. با این حال، هر گونه مقررات توسط OpenAI باعث اعتراض عمومی شد.

برخلاف قانون کپی رایت، قوانین ایالات متحده به طور جهانی از نحوه استفاده از تصاویر افراد متوفی محافظت نمی کند. با این حال، تعداد انگشت شماری از ایالت ها حقوق تبلیغات پس از مرگ را به رسمیت می شناسند.

تا زمانی که دادگاه ها یا ایالت ها محدودیت های قوی تری تعیین نکنند، خط مشی OpenAI “تسلیم اموال” تضمین زیادی نمی کند. برخی از کارشناسان حقوقی می گویند رویکرد آنها مقطعی و واکنشی است.

OpenAI در حال تلاش برای جبران است

OpenAI در ابتدا به طور پیش فرض اجازه تصاویر گسترده از افراد متوفی را می داد، مگر اینکه املاک مخالفت کنند. این سیاست جدید بهعنوان بخشی از یک تغییر شکل میگیرد، اما بسیاری معتقدند که این شرکت همچنان در حال پیگیری است. منتقدان خاطرنشان می کنند که ممنوعیت MLK ممکن است یکباره بوده باشد. کنترل بقیه محفظه پژواک هوش مصنوعی مشکل بسیار دشوارتری است.

در حالی که فیلمها، کتابهای درسی و آرشیوها از قبل نحوه به یاد آوردن تاریخ را واسطه میکنند، دروغهای عمیق هوش مصنوعی در معرض خطر تبدیل شدن به لنز دیگری هستند. چیزی که قابل توضیح نیست اگر کاربران بتوانند هر چیزی را که کینگ گفته یا انجام داده، «تصور مجدد» کنند، چه چیزی می تواند جلوی چندین دهه تحریف را بگیرد؟ صادقانه بگویم، ما در قلمروی ناشناخته هستیم.

با توجه به واکنشها، نمایندگان املاک یا دیگر شخصیتهای تاریخی ممکن است درخواست کنند از درج در تولید ویدیوی سورا چشم پوشی کنند.

در حالی که OpenAI علایق قوی در بیان آزاد را می شناسد، در درجه اول تصمیم گرفته است تا تصاویر خود را از MLK متوقف کند. اما شاید این فقط یک مورد آزمایشی باشد.

افکار نهایی

ارزش این را دارد که به این فکر کنیم که چرا و چگونه از چنین ابزارهای قدرتمند هوش مصنوعی استفاده می کنیم. این سؤال را در مورد نحوه رسیدگی OpenAI به موارد بعدی باز می کند. آیا شرکت فعالانه برخی از ارقام را مسدود خواهد کرد؟ وقتی میلیاردها ویدیو تولید شده است، چگونه می توانند همه آنها را کنترل کنند؟ آیا پاسخ ایجاد پایگاه داده از شباهت های غیرمجاز است یا باید به درخواست های دستی تکیه کرد؟

اگر از Sora یا ابزارهای ویدیویی هوش مصنوعی مشابه استفاده می کنید، این مکث یک علامت هشدار است. انتظار محدودیت های بیشتری را در مورد اینکه چه کسی (یا چه چیزی) می توانید در رسانه های تولید شده با هوش مصنوعی زنده کنید، داشته باشید.

همچنین دریچه ای را برای درک گسترده تری از مسئولیت پذیری هوش مصنوعی باز می کند. همانطور که نمیتوانیم با موتورهای قدرتمند یا بدون رعایت قوانین به جایی در جاده برویم، قدرت هوش مصنوعی نیز باید به نحوی مدیریت شود.

از شباهتهای افراد مشهور گرفته تا حافظه تاریخی، من شک ندارم که پلتفرمها به طور فزایندهای بر اساس نحوه مدیریت شکاف بین خلاقیت و رضایت قضاوت خواهند شد.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود. فراموش نکنید که روی دکمه Follow کلیک کنید!

اطلاعات بیشتر از راهنمای تام

بازگشت به لپ تاپ