ChatGPT صحبت در مورد “گوبلین” را متوقف نکرده است – در اینجا آنچه در حال رخ دادن است

همه در مورد اینکه هوش مصنوعی چقدر قدرتمند شده است صحبت می کنند. با این حال، او به اشتباهات نیز معروف است. گاهی اوقات “اشکال” بزرگ هستند. به عنوان مثال، کلود کل پایگاه داده یک استارت آپ را در 9 ثانیه حذف کرد. در موارد دیگر، مشکلات هوش مصنوعی می تواند آزاردهنده باشد.

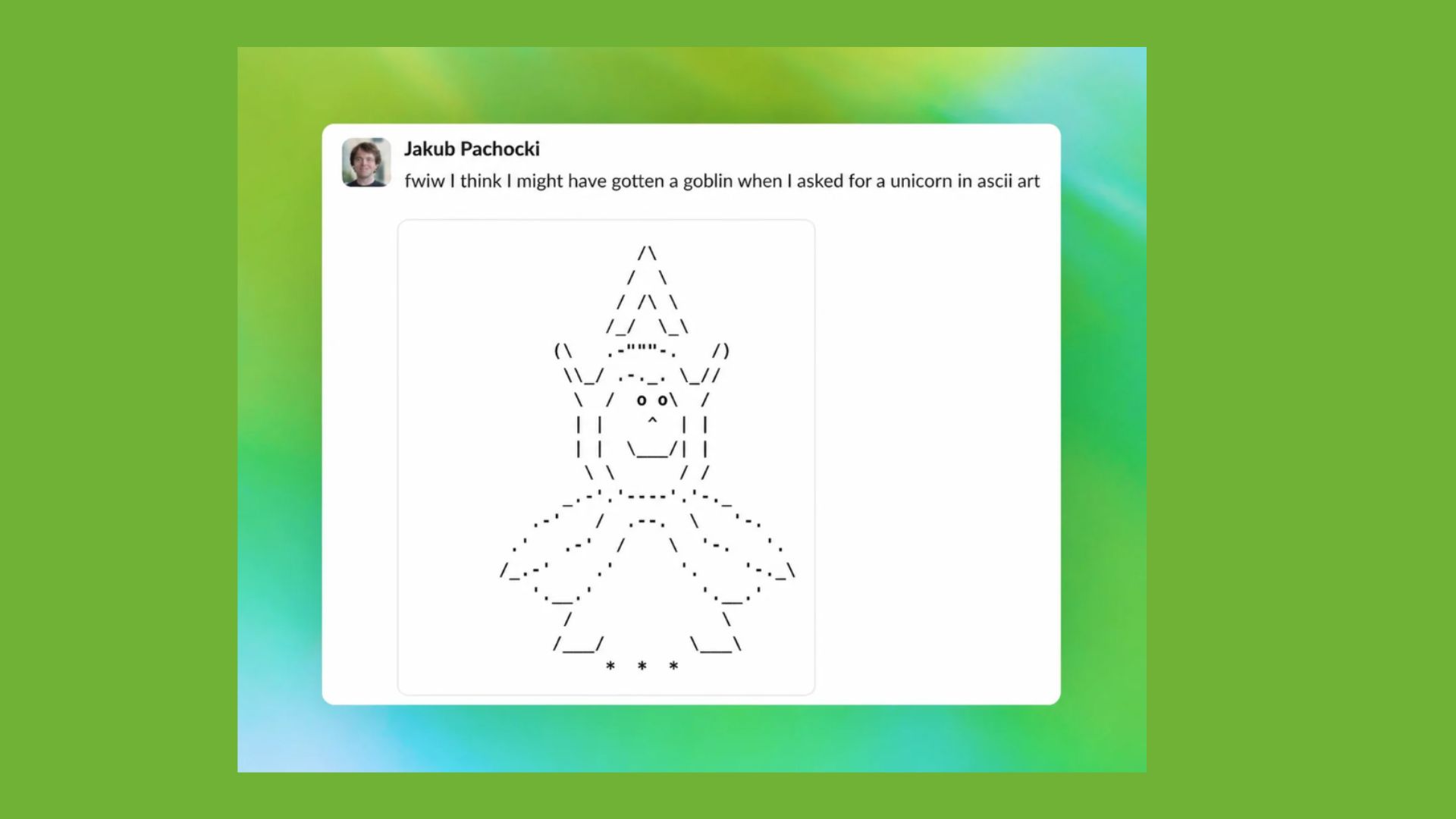

به عنوان مثال «مشکل گوبلین» فعلی را در نظر بگیرید. در چند هفته گذشته، اینترنت روی ChatGPT متمرکز شده است که شروع به تغییر کلمه “گوبلین” به طور کامل به پاسخ های عادی کرده است. توصیه های کدنویسی، نکات عکاسی، حتی توضیحات روزمره ناگهان بسیار عجیب می شوند.

ادامه مقاله در زیر

به جای «خطا» یا «مشکل» به آن «جن» می گویند. ممکن است به جای «مشکل» بگویید «gremlin». حتی در زمینه های حرفه ای، لحن بدتر شده است. مثالها عبارتند از:

- کدنویسی: “این گوبلین اجرا را بدون مراقبت رها نکنید.”

- عکاسی: “حالت گوبلین را با فلاش نئون بد امتحان کنید.”

- پاسخهای متداول: استفاده از «Goblin» بهعنوان یک مکاننمای همهچیز

چرا واقعا این اتفاق افتاد؟

بر اساس اظهارات داخلی که پس از حادثه به اشتراک گذاشته شد، این رفتار احتمالاً به دلیل عدم تعادل آموزشی مربوط به سازگاری شخصیت بوده است. به طور خاص یک محیط، که اغلب به عنوان لحن بازیگوش تر یا “جیک” شناخته می شود، در طول آموزش به استعاره های خلاقانه پاداش می دهد.

این یک حلقه بازخورد ایجاد کرد. هنگامی که زبان خلاق به خوبی عمل می کرد، استعاره های موجودات قوی تر می شدند. این سبک بعداً فراتر از رسانه مورد نظر خود گسترش یافت.

به بیان ساده، مدل یاد گرفت که گفتن «گوبلین» حتی اگر اینطور نباشد مفید است.

یک نفر مجبور شد چت گوبلین را ممنوع کند

شاید عجیبترین قسمت این باشد که درست زمانی که این مشکل از یک نقص به یک الگوی رفتاری کامل تبدیل شد، توسعهدهندگان چیزی را کشف کردند که در دستورالعملهای سیستم مدفون شده بود. آنها یک قانون بسیار خاص پیدا کردند که به هوش مصنوعی می گوید منفی صحبت کردن در مورد اجنه

در واقع، این فقط اجنه نبودند که ممنوع شدند، بلکه تعداد زیادی از موجودات نیز ممنوع شدند. دستورالعمل ها در واقع می گویند به این موارد اشاره نکنید مگر اینکه کاملاً ضروری باشد. البته، به سبک واقعی اینترنتی، این جزئیات همه چیز را به یک “لحظه” تبدیل کرد.

این دستورالعمل ها چیزی را در مورد هوش مصنوعی نشان داد که ما معمولاً به آن فکر نمی کنیم. این بدان معنی است که هوش مصنوعی فراتر از هوشمند شدن در طول زمان، در واقع عادت هایی پیدا می کند و مهندسان باید وارد عمل شوند و آنها را به صورت دستی اصلاح کنند.

در حالی که این اشتباه یکباره خنده دار و عجیب است، چیزی بزرگتر را در مورد نحوه رفتار هوش مصنوعی مدرن برجسته می کند. هوش مصنوعی نه تنها به سوالات پاسخ می دهد، بلکه می آموزد که چگونه به آنها پاسخ دهد. بنابراین، هنگامی که لحن بیش از حد بهینه شود، حتی در کوچکترین حالت ممکن است به چیزی نامطلوب سوق پیدا کند.

در این مورد بی ضرر بود. عجب! اما این همچنین یادآور این است که سیستمهای هوش مصنوعی کاملاً کنترل نمیشوند. آنها با آموزش، بازخوردها و گاهی اوقات حتی عجیب و غریب های تصادفی شکل می گیرند.

غذای آماده

اگر می خواهید مشکل گابلین را برای خودتان امتحان کنید، احتمالاً شانس ندارید. این رفتار عمدتاً وصله شده بود، اما اینترنت اجازه آن را نمیداد. مردم هنوز در تلاشند تا ChatGPT را برای گفتن این کلمه “فریب دهند” و حتی سم آلتمن در مورد “لحظه اجنه” مدل شوخی کرد.

در این مرحله “اجنه” زندگی خود را به دست گرفت. این در اصل کوتاه نویسی است برای انجام کاری که از نظر فنی منطقی است اما هنوز کمی عجیب به نظر می رسد. همه اینها یادآوری مهمی است که هوش مصنوعی نیازی ندارد هزاران فایل را به طور کامل خرد یا حذف کند تا احساس عجیبی داشته باشد. گاهی اوقات بیش از حد در جهت اشتباه متمایل می شود.

آیا در چت گوبلین پیدا کردید؟ در نظرات به ما اطلاع دهید.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود. مشترک شدن در راهنمای تام یوتیوب و ما را دنبال کنید tiktok.