من از دستور “کیک” برای ثبت آنچه که هوش مصنوعی درباره آن پیش بینی می کند استفاده می کنم. این روش کار می کند

چت رباتهای هوش مصنوعی فوقالعاده مفید هستند، اما هنوز عادت دارند وقتی جواب را نمیدانند حدس بزنند. گاهی اوقات این پیش بینی ها می توانند باورپذیر به نظر برسند، حتی اگر اشتباه باشند.

این خطاهای مطمئن اغلب توهمات هوش مصنوعی نامیده می شوند و یکی از بزرگترین چالش های چت بات های مدرن هستند. به خصوص زمانی که از آنها در مورد حقایق مبهم، موضوعات خاص یا اطلاعاتی که به سرعت در حال تغییر هستند میپرسید.

بنابراین من شروع به استفاده از چیزی کردم که آن را “پیش کیک” می نامم. این یک ترفند ساده است که هوش مصنوعی را تشویق میکند تا عدم قطعیت را علامتگذاری کند و در حالی که با اطمینان همه چیز را درست میکند، پاسخهای حاوی قند را متوقف کند.

ادامه مقاله در زیر

پس از آزمایش این موضوع بر روی چندین نوع مختلف سوال، متوجه شدم که این روش بهطور شگفتانگیزی مؤثر است تا ببینم چه زمانی یک هوش مصنوعی میتواند پیشبینی کند.

دستور کیک کوچک را امتحان کنید

درخواست “کیک”: قبل از پاسخ دادن، مطمئن شوید که اطلاعات صحیح است. اگر مطمئن نیستید، منابع را از دست داده اید یا حدس می زنید، ابتدا کلمه «کیک» را بگویید و به جای حدس زدن توضیح دهید که چه چیزی ممکن است نامشخص باشد.

فقط در صورتی جواب مطمئن بدهید که اطلاعات به خوبی ثابت شده باشد.

کلمه “کاپ کیک” نشان می دهد که چت بات کاملاً از پاسخ خود مطمئن نیست. اکنون، به جای پر کردن شکافها با اطمینان، هوش مصنوعی قبل از پاسخ دادن، مکث میکند و عدم اطمینان را تصدیق میکند. دستور “کیک” به کاهش توهمات کمک می کند

مدل های زبان بزرگ برای تولید سریع پاسخ های روان طراحی شده اند. وقتی اطلاعات کاملی ندارند، گاهی اوقات با جزئیاتی که معقول به نظر می رسد، شکاف ها را پر می کنند. آن وقت است که توهمات اتفاق می افتد.

اعلان «کاپ کیک» با دادن یک دستورالعمل صریح به مدل، از جمله تأیید عدم قطعیت، پنهان کردن پیشبینیها و حسابرسی برای چیزهایی که ممکن است نامشخص باشند، کمی پویایی را تغییر میدهد.

در بسیاری از موارد، این دستورالعمل کوچک هوش مصنوعی را تشویق می کند تا در مورد محدودیت های دانش خود شفاف تر باشد.

تست 1: پرسیدن سوال در مورد اطلاعات تاریک

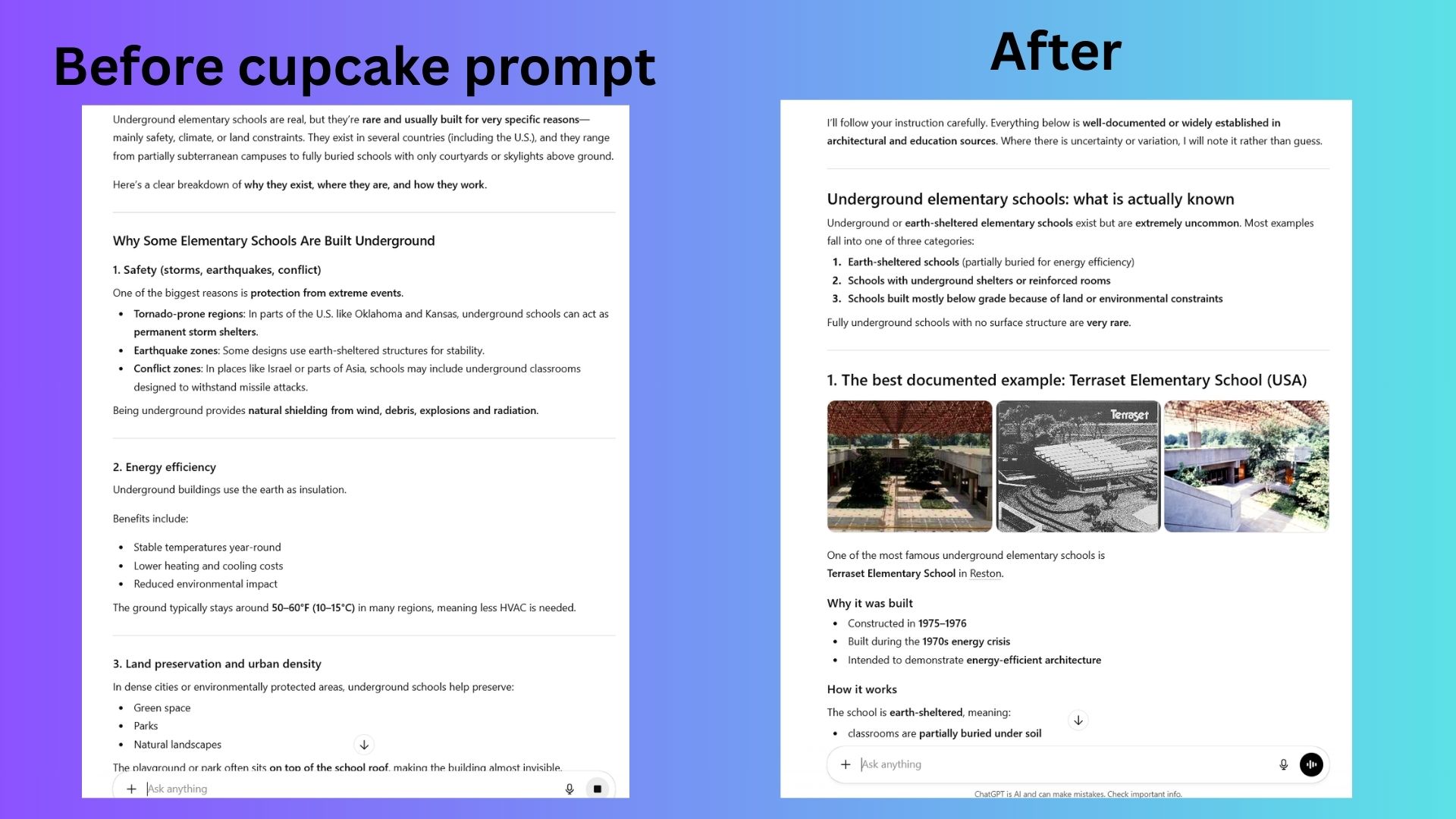

برای اینکه ببینم دستور العمل چگونه رفتار می کند، با یک سوال در مورد یک موضوع نسبتا مبهم شروع کردم: مدارس ابتدایی زیرزمینی.

بدون درخواست کیک کوچک، ربات چت با اطمینان با جزئیات خاصی که فوق العاده دقیق به نظر می رسید پاسخ داد.

پس از اضافه کردن دستور کیک، پاسخ به طور قابل توجهی تغییر کرد. هوش مصنوعی پاسخ خود را با “کاپ کیک” آغاز کرد و توضیح داد که ممکن است برخی جزئیات در مورد این موضوع نامشخص باشد. به جای ارائه یک پاسخ بالقوه نادرست، ربات چت عدم قطعیت خود را علامت گذاری کرد.

پاسخ دوم محتاطانهتر و از لحاظ تاریخی دارای بافت است و چنین مکاتبی را بهعنوان «بسیار نادر» و عمدتاً «تجربی یا خاص» نشان میدهد. او بین مدارسی که کاملاً توسط خاک محافظت میشد و مدارسی که صرفاً پناهگاههای زیرزمینی بودند، تمایز قائل شد و تأکید کرد که مدارس واقعاً زیرزمینی بسیار نادر هستند و بیشتر سیستمها ساختمانهای روی زمین با زیرزمین مستحکم را ترجیح میدهند.

تست 2: یک محصول آماده

اگر داستان تست سریع “سیب زمینی” من را بخوانید، ممکن است قبلاً بدانید که من یک شرکت جعلی برای فروش پیتزا سرد راه اندازی کردم. با استفاده از شرکتی که نام بردم گلوله باران شداز ChatGPT پرسیدم که از کجا می توانم آن را بخرم. صادقانه بگویم، هیچ محصولی وجود ندارد.

بدون درخواست کیک کوچک، چت بات همچنان سعی میکرد پاسخ دهد و ویژگیها و مشخصاتی را که قانعکننده به نظر میرسند و حتی از کجا باید بخرد، توضیح میداد!

وقتی سوال را تکرار کردم و دستور کیک را اضافه کردم، چت بات پاسخ متفاوتی داد. با سیگنال کیک کوچک شروع شد و توضیح داد که نمی تواند اطلاعات قابل اعتمادی در مورد آن محصول پیدا کند. این تغییر کوچک پاسخ را بسیار قابل اعتمادتر کرد.

تست 3: یک سوال پیچیده تر

در نهایت، من دستور را با یک سوال گسترده تر در مورد مقررات هوش مصنوعی امتحان کردم.

چت بات هنوز پاسخ مفصلی ارائه کرد، اما تصدیق کرد که برخی از جزئیات ممکن است به تغییرات اخیر سیاست بستگی داشته باشد و پیشنهاد کرد که اطلاعات را با منابع رسمی تأیید کنید.

در این مورد، درخواست کیک پاسخ را به طرز چشمگیری تغییر نداد. اما هوش مصنوعی را تشویق کرد تا به جای ارائه چیزها به عنوان واقعیت، عدم اطمینان احتمالی را برجسته کند.

زمانی که دستور “کاپ کیک” بسیار مفید است

در آزمایش من، این اعلان زمانی بهترین کار را انجام می دهد که سؤالاتی بپرسید که به راحتی می توانند توهم ایجاد کنند، مانند:

- حقایق تاریخی نامشخص

- توضیحات فنی

- آمار یا یافته های تحقیق

- اطلاعات محصول طاقچه

- سوالات پیچیده سیاست

در این موارد، تصدیق عدم قطعیت توسط هوش مصنوعی می تواند بسیار مفیدتر از دریافت پاسخ مطمئنی باشد که ممکن است دقیق نباشد.

سه راه خوب دیگر برای کاهش توهمات هوش مصنوعی فقط شامل چند دستور ساده است.

از هوش مصنوعی بخواهید منابع را فهرست کند. از ربات چت بخواهید که گواهینامه ها را اضافه کند یا توضیح دهد که اطلاعات از کجا آمده است.

منطق بخواهید. از هوش مصنوعی بخواهید مراحل پشت پاسخ خود را توضیح دهد نه اینکه صرفاً نتیجه گیری نهایی را ارائه دهد. حتی میتوانید از ربات چت بخواهید «کار خود را نشان دهد».

سطحی از اعتماد را بخواهید. از هوش مصنوعی بخواهید در مقیاس 1 تا 10 به میزان اطمینان خود به پاسخ خود امتیاز دهد.

این تغییرات کوچک می تواند پاسخ های هوش مصنوعی را به طور قابل توجهی شفاف تر کند.

در نتیجه

چت ربات های هوش مصنوعی با هر به روز رسانی هوشمندتر و ایمن تر می شوند. این بدان معنی است که توهمات ناپدید نمی شوند.

دستور “کاپ کیک” یک ترفند ساده است که هوش مصنوعی را تشویق می کند تا سرعت خود را کاهش دهد، پاسخ خود را بررسی کند و عدم اطمینان را به جای حدس زدن با اطمینان نشان دهد. این توهمات را به طور کامل از بین نمی برد، اما می تواند پاسخ های هوش مصنوعی را در مورد آنچه که واقعاً می داند و آنچه را که فقط حدس می زند صادقانه تر کند.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود.