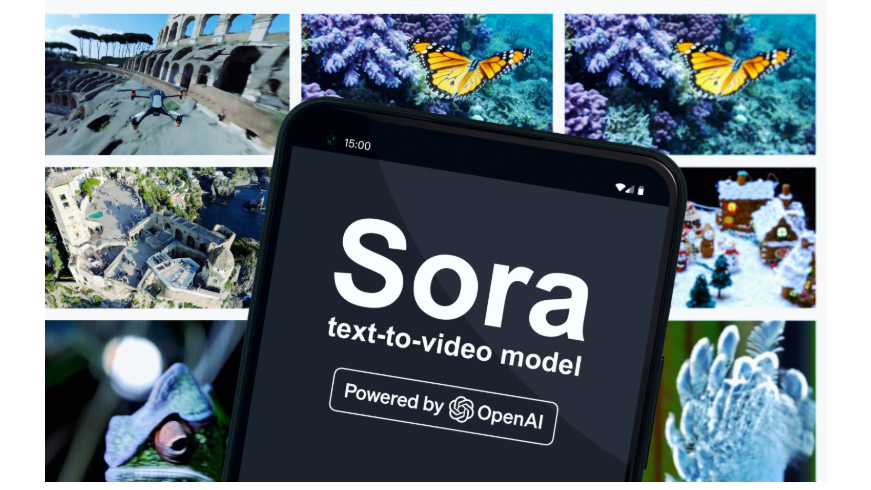

OpenAI پس از فشار برایان کرانستون و SAG-AFTRA، حفاظهای مربوط به دیپفیکهای افراد مشهور را محکم میکند – در اینجا همه چیزهایی است که باید بدانید

وقتی OpenAI Sora 2 را منتشر کرد، تیم تصمیم بحثبرانگیزی گرفت تا به کاربران اجازه دهد ویدیوهایی با افراد واقعی ایجاد کنند و به افراد مشهور اجازه استفاده از شباهتهای آنها را ندهند.

جای تعجب نیست که این نتیجه معکوس داشت. پس از انبوهی از محتوای نامناسب شامل چهرههای برجسته، سام آلتمن تغییری در قوانینی را اعلام کرد که بر حرکت از انصراف به انتخاب کردن تمرکز دارد و یک سلبریتی را ملزم میکند تا تصمیم بگیرد که آیا میخواهد از شباهت آنها استفاده شود یا خیر.

اما به نظر می رسد که این به اندازه کافی برای علاقه OpenAI کار نمی کند. این شرکت قبلاً مجبور شده بود از خانواده مارتین لوتر کینگ به دلیل انتشار ویدیوهای نامناسب از این مدل عذرخواهی کند.

اگرچه ویدیوهای کینگ در حال حاضر محدود شده است، شخصیت های تاریخی دیگری مانند JFK و پروفسور استیون هاوکینگ نیز در حال پخش شدن هستند.

با این حال، این فقط شخصیت های تاریخی نیستند که پرچم را به اهتزاز در می آورند. بازیگر برایان کرانستون، در بیانیه مشترک خود با SAG-AFTRA و OpenAI، تاکید کرد که در Sora 2 استفاده شده است، حتی اگر او ترجیح داده نشده باشد.

کرانستون در بیانیه ای گفت: “من نه تنها برای خودم، بلکه برای همه هنرمندانی که کار و هویت آنها ممکن است به این شکل مورد سوء استفاده قرار گیرد، عمیقا نگران بودم.”

من از OpenAI به خاطر سیاستهایشان و بهبود نردههای محافظشان سپاسگزارم و امیدوارم که آنها و همه شرکتهای درگیر در این کار به حق شخصی و حرفهای ما برای مدیریت بازتولید صداها و شباهتهایمان احترام بگذارند.»

در حالی که OpenAI به طور مشخص اعلام نکرده است که این تغییرات در سیاست و گاردریل چیست، اما وعده می دهد که توانایی کاربر را برای بازآفرینی افرادی که تصمیم به غیرفعال کردن رندر سورا 2 دارند، کاهش می دهد.

سام آلتمن، مدیر عامل OpenAI در بیانیه ای از SAG-AFTRA گفت: “OpenAI عمیقا متعهد به محافظت از هنرمندان در برابر سوء استفاده از صداها و شباهت های آنها است. ما یکی از اولین حامیان قانون NO FAKES در سال گذشته بودیم و ما همیشه پشتیبان حقوق هنرمندان خواهیم بود.”

قانون NO FRAUD قانونی بود که امسال معرفی شد و هدف آن محافظت از صدا و شباهت همه افراد در برابر تفریحات کامپیوتری است.

Sora 2 از OpenAI تنها رندر هوش مصنوعی در بازار نیست و بسیاری می توانند ویدیوهایی با کیفیت مشابه ایجاد کنند. پس چرا به نظر می رسد OpenAI تنها موردی است که با واکنش های منفی مواجه است؟

همه چیز بستگی به نحوه رویکرد OpenAI به حق چاپ با این مدل دارد. امثال سازنده ویدیوی گوگل جمینی، Veo 3، برای اجتناب از شباهت به افراد مشهور و شخصیت های تاریخی طراحی شده است.

در واقع، در مقایسه با Sora 2، Gemini و اکثر سازندگان ویدیوی هوش مصنوعی با تدابیر امنیتی نسبتاً شدید ساخته شدهاند و برای مدت طولانی ساخته شدهاند.

حتی مدل اصلی Sora OpenAI هم این مشکل را نداشت. وقتی نوبت به Sora 2 رسید، OpenAI تصمیم گرفت درها را باز کند. در حالی که این یک حرکت مخاطره آمیز است و ترافیک زیادی را برای OpenAI ایجاد کرده است، اما منشا مشکلات اخیر این شرکت نیز بوده است.

آماندا کاسول، ویرایشگر هوش مصنوعی Tom’s Guide در ایالات متحده، هفته گذشته نگرانیهای فزاینده درباره Sora 2 را لمس کرد و گفت: “ابزارهای هوش مصنوعی مانند Sora به کاربران اجازه میدهند نمادهای فرهنگی قدیمی را تصور کنند یا از آنها تقلید کنند، اما اصول اخلاقی این امر به سرعت محو میشود. آیا این یک ادای احترام، طنز یا توهین است؟ مکث برای این موضوع خالی از لطف نیست.” تاکید می کند.”

حتی قبل از انتشار Sora 2، در طی یک جلسه توجیهی با OpenAI که شامل سم آلتمن نیز میشد، من و سایر روزنامهنگاران از جنبه منفی ارائه چنین ابزارهای قدرتمند هوش مصنوعی به کاربران سؤال کردیم.

در تلاش برای متمایز شدن در یک بازار شلوغ، OpenAI در حال انجام حرکات بحث برانگیز فزاینده ای است. جدا از نگرانیهای سورا 2 در مورد حق چاپ، این شرکت اخیراً اعلام کرده است که قصد دارد ویژگیهای بزرگسالان را با محدودیت سنی به ChatGPT اضافه کند و نحوه برخورد ChatGPT با سلامت روان را تغییر دهد تا شخصیت بیشتری در مدل خود ایجاد کند.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود. فراموش نکنید که روی دکمه Follow کلیک کنید!

اطلاعات بیشتر از راهنمای تام

بازگشت به لپ تاپ