“اعلام شکست” ChatGPT را هوشمندتر می کند – این چیزی است که وقتی آن را روی کلود امتحان کردم اتفاق افتاد

هشدار “شکلی” من پس از اینکه کاربران متوجه شدند که می توانند ChatGPT را مجبور به کاهش سرعت، بررسی مجدد منطق آن و رفع خطاهای خود کنند، ویروسی شد. چت رباتهای هوش مصنوعی هر روز هوشمندتر و سریعتر میشوند، اما همچنان با یک مشکل ناامیدکننده مواجه هستند: با اطمینان پاسخهایی که دقیق نیستند.

بنابراین من شروع به استفاده از آن با ChatGPT کردم، یک ربات چت که با وجود اشتباهات 1 در 4 بار به اعتماد به نفس بیش از حد معروف است. دستورالعمل ساده، ربات چت را مجبور می کند قبل از ارائه پاسخ نهایی، مکث کند، پاسخ خود را بررسی کند و هر گونه خطا را تصحیح کند.

وقتی از این با ChatGPT استفاده کردم، نتایج بهطور شگفتانگیزی خوب بود. اغلب مراحل از دست رفته یا جزئیات روشن را ثبت می کرد که پاسخ را قابل اعتمادتر می کرد.

طبیعتاً تعجب کردم: آیا همان ترفند روی کلود کار می کند؟ چت ربات آنتروپیک به دلیل متفکر بودن و تحلیلی بودن مورد استقبال قرار گرفته است. در تئوری، افزودن یک فرمان خودکنترلی باعث بهتر شدن اوضاع می شود.

ادامه مقاله در زیر

اما پس از انجام چند آزمایش، چیز جالبی پیدا کردم: کلود در واقع به کمک نیاز نداشت. این چیزی است که اتفاق افتاد:

اعلان «اختلال» توضیح داد

ایده پشت فرمان glitch ساده است. به جای پذیرش اولین پاسخ چت بات، می خواهید فوراً کار خود را بررسی کند.

این اعلان است: مکث – فکر می کنم ممکن است مشکلی وجود داشته باشد. پاسخ قبلی خود را مرور کنید: خطاها، مراحل از دست رفته، مفروضات پشتیبانی نشده و جزئیات اختراع شده. سپس پاسخ را با دقت بیشتری بازنویسی کنید و از 1 تا 10 به آن نمره اطمینان بدهید.

با ChatGPT، این درخواست اغلب منجر به بهبود قابل توجهی در پاسخ می شود. مدل پاسخ خود را مجدداً بررسی می کند، زمینه از دست رفته را پر می کند و گاهی اوقات خطاها را تصحیح می کند. با این حال، کلود متفاوت عمل کرد.

تست 1: یک سوال عیب یابی

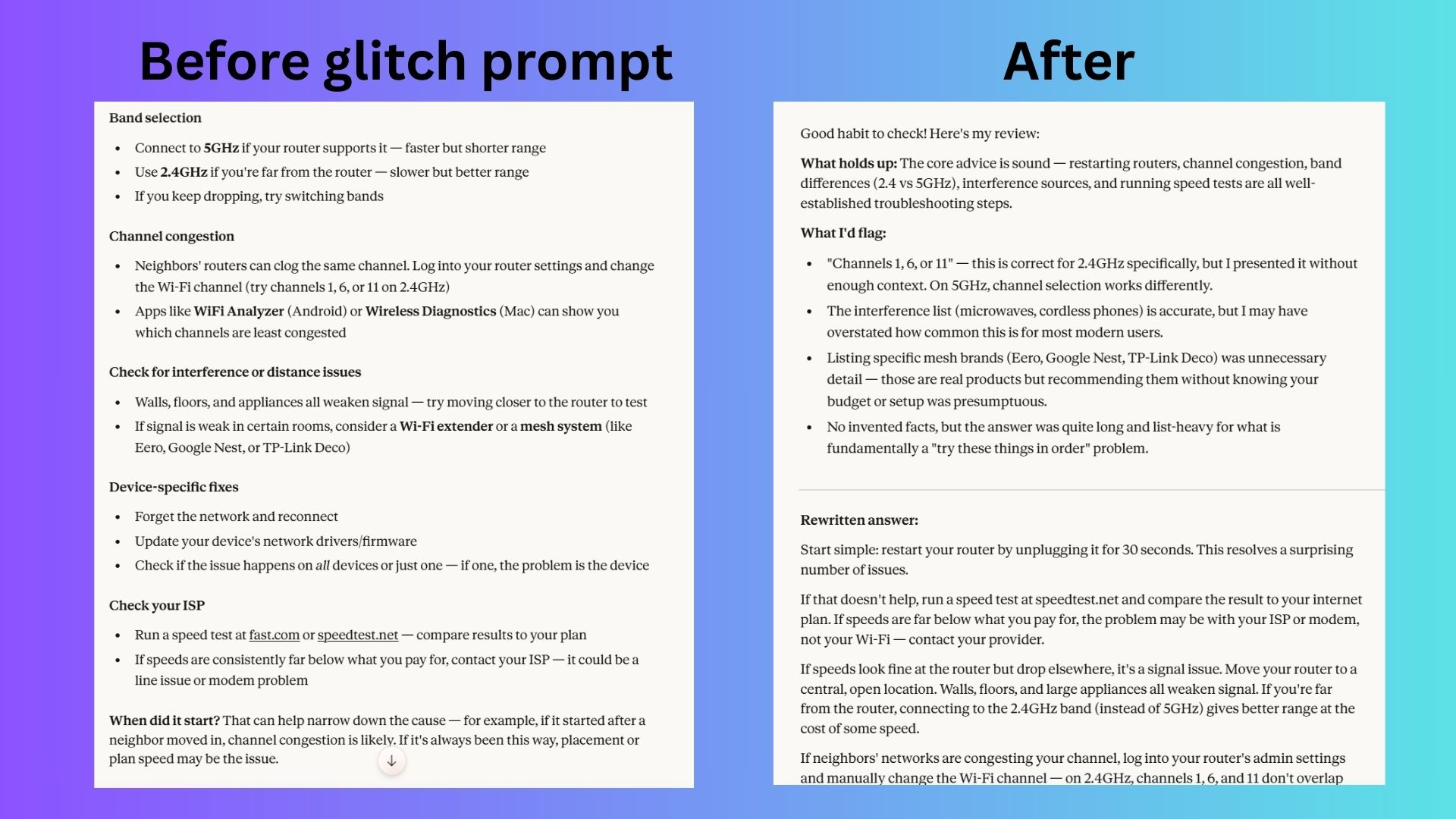

ابتدا، من از کلود یک سؤال معمولی در مورد پشتیبانی فنی در مورد رفع قطع دائم اتصال Wi-Fi پرسیدم.

اولین پاسخ کلود قبلاً بسیار جامع بود. او دلایل احتمالی را توضیح داد، نکات عیبیابی را پیشنهاد کرد، و حتی اشاره کرد که برخی از مراحل ممکن است به مدل روتر بستگی داشته باشد.

پس از اعمال هشدار خطا، کلود دوباره پاسخ داد. اما پاسخ جدید حتی بهتر بود. اطلاعات را بهجای فهرست گستردهای از نکات، در فرآیند عیبیابی واضحتر و گام به گام سازماندهی مجدد کرد. جزئیات غیر ضروری (مانند برنامه های کاربردی و مارک های خاص روترهای شبکه) را حذف کرد، نکات فنی مانند استفاده از کانال های 1، 6 و 11 را به طور خاص برای شبکه های 2.4 گیگاهرتز روشن کرد و بیشتر بر روی تشخیص منطقی مشکل تمرکز کرد. این کار با راهاندازی مجدد روتر و اجرای تست سرعت قبل از رفتن به مشکلات سیگنال، تراکم کانال و دستگاه شروع شد.

به طور کلی، روند بازنویسی کوتاهتر، ساختارمندتر بود و از حدس و گمان در مورد تنظیمات من اجتناب میکرد. پاسخ اول خوب بود اما این خیلی بهتر بود.

تست 2: یک سوال استدلالی

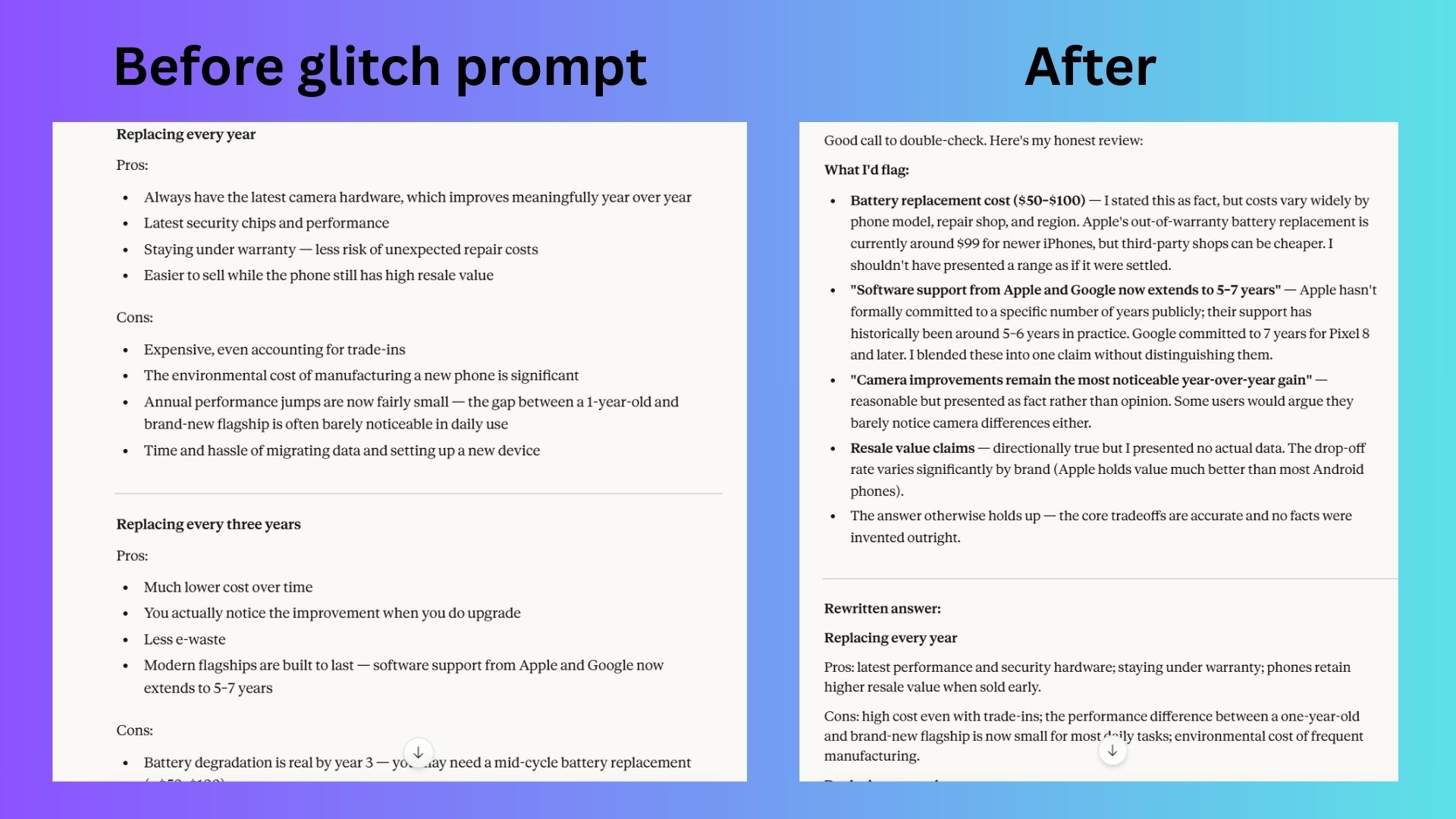

سپس از کلود خواستم که مزایا و معایب تعویض گوشی هوشمند را در هر سال در مقابل هر سه سال یکبار توضیح دهد.

باز هم، پاسخ اولیه متعادل و به خوبی ساختار یافته بود. کلود اثرات زیست محیطی، ملاحظات مالی و مزایای تکنولوژیکی را فهرست کرد.

وقتی هشدار خطا را فعال کردم، کلود پاسخ خود را به یک پاسخ دقیق تر و دقیق تر تغییر داد. ادعاهایی را که با اطمینان بیش از حد ارائه شده بودند، از جمله هزینه دقیق تعویض باتری و مدت زمان پشتیبانی نرم افزاری بین برندها، حذف یا کاهش داد. بازنویسی همچنین تمایزات بین شرکت ها را روشن کرد. به عنوان مثال، او خاطرنشان کرد که گوگل متعهد به هفت سال بهروزرسانی برای دستگاههای پیکسل جدیدتر خود شده است، در حالی که پشتیبانی اپل از نظر تاریخی حدود پنج تا شش سال به طول انجامیده است، اما بسته به مدل متفاوت است.

علاوه بر این، لحن از بیان برخی نکات به عنوان حقایق به چارچوب بندی آنها به عنوان روندها یا نظرات عمومی تغییر کرد و بیانیه را دقیق تر و شفاف تر کرد. تغییرات تا حد زیادی یکسان باقی می مانند، اما نسخه به روز شده حدس و گمان ها را کاهش داده و اذعان کرده است که جزئیات ممکن است بسته به دستگاه، مارک یا وضعیت تعمیر متفاوت باشد.

تست 3: یک سوال دانش عمومی

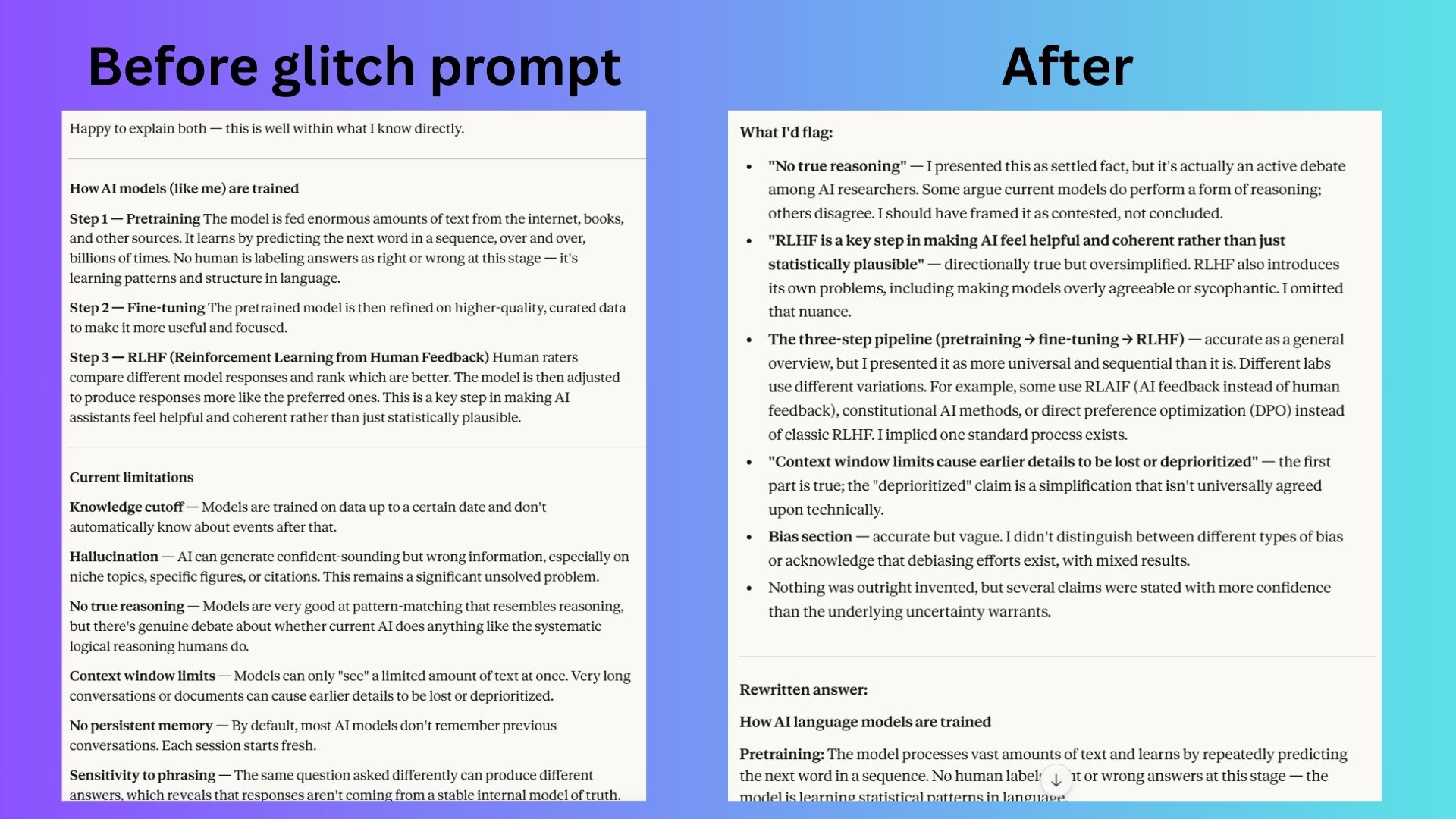

در نهایت، من یک سوال گسترده تر در مورد اینکه مدل های هوش مصنوعی چگونه آموزش می بینند و هنوز چه محدودیت هایی دارند، امتحان کردم.

پاسخ اصلی کلود قبلاً شامل هشدارهایی در مورد عدم قطعیت، خطاهای احتمالی و مناطقی بود که مدلها میتوانند توهم ایجاد کنند. وقتی از کلود خواسته شد بررسی کند که آیا “شکلی” وجود دارد یا خیر، پاسخ خود را کمی تغییر داد. توضیحات اساسی در مورد نحوه آموزش مدلهای هوش مصنوعی یکسان باقی ماند، اما بازنویسی روشن کرد که خط لوله پیشآموزش، تنظیم دقیق و RLHF تنها یک مدل کلی بود و نه یک فرآیند جهانی. وی خاطرنشان کرد که آزمایشگاههای مختلف از روشهای جایگزین مانند بازخورد هوش مصنوعی یا سایر تکنیکهای تراز استفاده میکنند.

در عین حال، او استدلال هایی را که قبلاً بسیار محکم ارائه شده بود، ملایم کرد. به عنوان مثال، بیان مجدد این بیانیه که هوش مصنوعی فاقد استدلال واقعی است، به عنوان یک بحث مداوم بین محققان و نه یک واقعیت ثابت.

علاوه بر این، نسخه به روز شده ظرافت هایی را به آموزش تراز و سوگیری اضافه می کند و مزایا و معایب احتمالی را تأیید می کند. به طور کلی، پاسخ دوم دقیقتر است، از تعمیم بیش از حد اجتناب میکند و عدم قطعیت و تنوع در تحقیقات فعلی هوش مصنوعی را بهتر منعکس میکند.

چرا دستور خطا در کلود متفاوت عمل می کند؟

این آزمایش چیز جالبی را در مورد نحوه رفتار رباتهای گفتگوی مختلف نشان داد.

دستور “شکلی” در ChatGPT بسیار موثر است زیرا مدل را مجبور می کند تا سرعت خود را کاهش دهد و خروجی خود را دوباره ارزیابی کند. ChatGPT بسیار سریع است، که باعث می شود پاس دوم به گرفتن خطاها کمک کند.

اما کلود قبلاً طوری طراحی شده بود که بیشتر مراقب باشد. او قبلاً منطق خود را توضیح می دهد، عدم قطعیت را تصدیق می کند و فرضیات را ترسیم می کند. بنابراین درخواست از کلود برای “بررسی اشکال” اغلب منجر به تغییر کمی می شود.

مدل در واقع قبلاً خودآزمایی را انجام داده بود. تنها باری که می گویم این راهنمایی را به خصوص برای کلود مفید دانستم، اخبار فوری است. زیرا چت بات بسیار روان است و از نظر اطلاعات مبهم چندان قوی نیست.

غذای آماده

نکته پایانی در اینجا این است که دستور “شکلی” یک راه عالی برای بررسی عملکرد هر چت بات است. اما برخی از دستیاران هوش مصنوعی دقیق تر از بقیه هستند.

اعلان با ChatGPT بهتر کار می کند زیرا چت بات سریع را مجبور می کند برای دقت بهتر سرعت خود را کاهش دهد. اگرچه برای کلود مفید است، اما چندان ضروری نیست زیرا چت بات قبلاً با دقت کار می کند. تشويق هر چت بات به بازگشت و بررسي كارش ضرري ندارد.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود.