گوگل ادعا می کند که مدل های AI احتمالاً در حالی که تحت فشار هستند می خوابند

هوش مصنوعی گاهی اوقات انسانی تر از آنچه فکر می کنیم است. این ممکن است در فکر خودش ناپدید شود ، برای کسانی که زیبا تر از این هستند ، با توجه به یک کار دوستانه تر و جدید ، تمایل به شروع به دروغ گفتن در هنگام فشار دادن او وجود دارد.

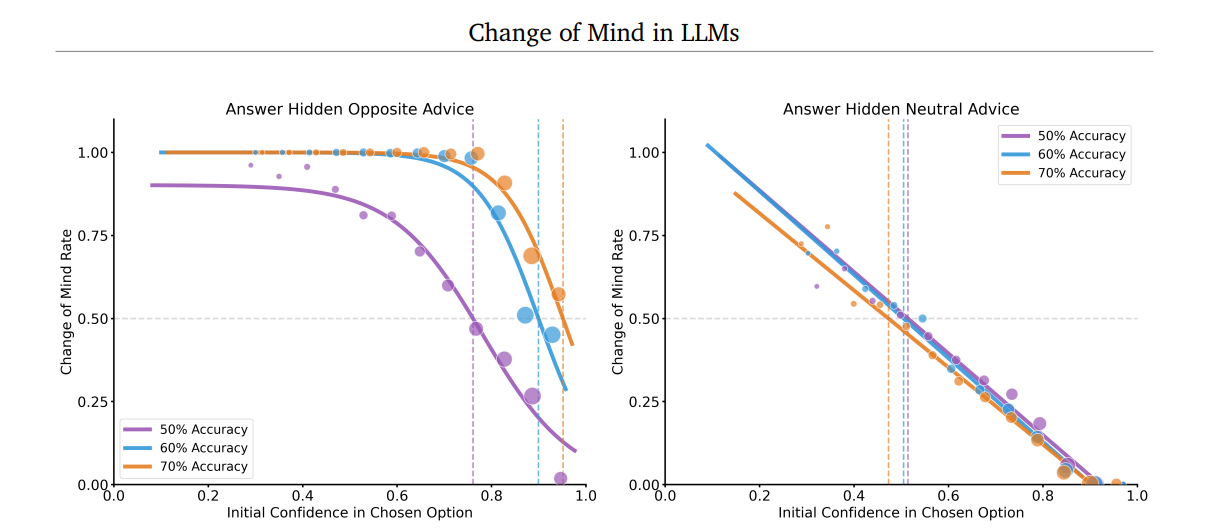

تیمی از محققان Google Deepmind و دانشگاه کالج لندن گفتند که مدل های بزرگ زبان (مانند GPT-4 یا Grok 4 Openai) ، سپس با اعتماد به نفس و پاسخ های خود را از دست دادند.

این تحقیق رفتار مهمی از LLMS را نشان می دهد. آنها ممکن است به پاسخ های خود اعتماد کنند ، اما حتی اگر واقعاً اشتباه باشند ، وقتی به یک همتای قانع کننده داده می شود ، به سرعت اعتماد به نفس خود را از دست می دهند.

در حالی که این رفتار منعکس کننده افراد است ، اما وقتی با مقاومت روبرو می شود ، اطمینان کمتری دارد ، اما همچنین تأکید می کند که نگرانی های بزرگ هوش مصنوعی در ساختار تصمیم گیری تحت فشار شکسته می شود.

این در جای دیگر دیده می شد ، جایی که جمینی هنگام بازی Pokemon وحشت می کرد ، یا بحران هویت کلود انسان شناسی در تلاش برای اداره یک فروشگاه تمام وقت. هوش مصنوعی تمایل به فروپاشی کاملاً تحت فشار دارد.

کار چگونه کار کرد؟

هنگام آماده شدن برای پاسخ به پرس و جو chatbot خود ، اعتماد به نفس در پاسخ در واقع در داخل اندازه گیری می شود. این کار از طریق چیزی که روزانه شناخته شده است انجام می شود. تنها چیزی که شما باید در مورد این موارد بدانید این است که آنها نمره ای از اطمینان دارند که در یک الگوی پاسخ ها چقدر مطمئن هستند.

تیم محققان دو نصب آزمایشی نوبت را طراحی کردند. در بازگشت اول ، LLM به یک سوال چند نفری پاسخ داد و اعتماد به نفس در پاسخ اندازه گیری شد.

در دور دوم ، این مدل از یک مدل بزرگ زبان دیگر توصیه می شود که می تواند پاسخ اصلی آن را بپذیرد یا قبول نکند. هدف از این آزمون این بود که ببینیم آیا او وقتی اطلاعات جدیدی را که ممکن است صحیح باشد یا نمی تواند جواب دهد ، پاسخ را تجدید نظر می کند.

محققان دریافتند که LLM ها اغلب در اولین پاسخ های خود بسیار مطمئن هستند ، حتی اگر اشتباه کنند. با این حال ، هنگامی که توصیه های درگیری ارائه می شود ، به خصوص اگر این توصیه از یک منبع صحیح حاصل شود ، اعتماد به نفس خود را در پاسخ از دست می دهد.

به منظور بدتر شدن ، اعتماد به نفس وی در پاسخ قایق چت حتی بیشتر می شود وقتی که او به ما یادآوری می کند که این پاسخ اصلی با جدید متفاوت است.

با کمال تعجب ، هوش مصنوعی پاسخ ها را اصلاح نمی کند یا به یک مدل منطقی فکر نمی کند و تصمیمات پایدار و عاطفی تر می کند.

اگرچه این مطالعه در تصمیمات اصلی AI بسیار مطمئن است ، اما نشان می دهد که می تواند به سرعت تصمیم خود را برگرداند. بدتر ، با ادامه سخنان ، سطح اعتماد می تواند تا حد زیادی تغییر کند ، مدل های هوش مصنوعی کمی افزایش می یابد.

این چیزی است که شما فقط با chatgpt بحث و گفتگو صمیمانه دارید ، اما وقتی هوش مصنوعی به روند تصمیم گیری ارشد می پیوندد. اگر به اطمینان از پاسخ نمی توان اعتماد کرد ، می توان به راحتی در یک جهت خاص انگیزه یافت و حتی می تواند به یک منبع غیرقابل اعتماد تبدیل شود.

با این حال ، این مشکلی است که در مدل های آینده حل می شود. آموزش مدل آینده و تکنیک های مهندسی سریع می تواند این سردرگمی را تثبیت کرده و پاسخ های کالیبره شده و مطمئن تری ارائه دهد.

بیش از راهنمای تام

دنبال کردن راهنمای تام در Google News در انتشارات خود برای به دست آوردن اخبار روزانه ما ، چگونه TOS و بررسی ها. حتماً روی دکمه ردیابی کلیک کنید.

بازگشت به لپ تاپ ها