هوش شخصی Gemini را برای یک هفته بستم – دیگر برنمی گردم

من اغلب در صف آزمایش ویژگیهای جدید هوش مصنوعی هستم، بهویژه آنهایی که قول میدهند زندگی را آسانتر کنند. ابزارهای حافظه، برنامههای متصل، توصیههای شخصیسازیشده و ابزارهای مشابه از نظر تئوری خوب به نظر میرسند، زیرا قول میدهند با یادگیری نحوه کار دستیاران را باهوشتر کنند. در حالی که من عاشق حافظه ChatGPT بودم، هوش شخصی Gemini بسیار متفاوت بود.

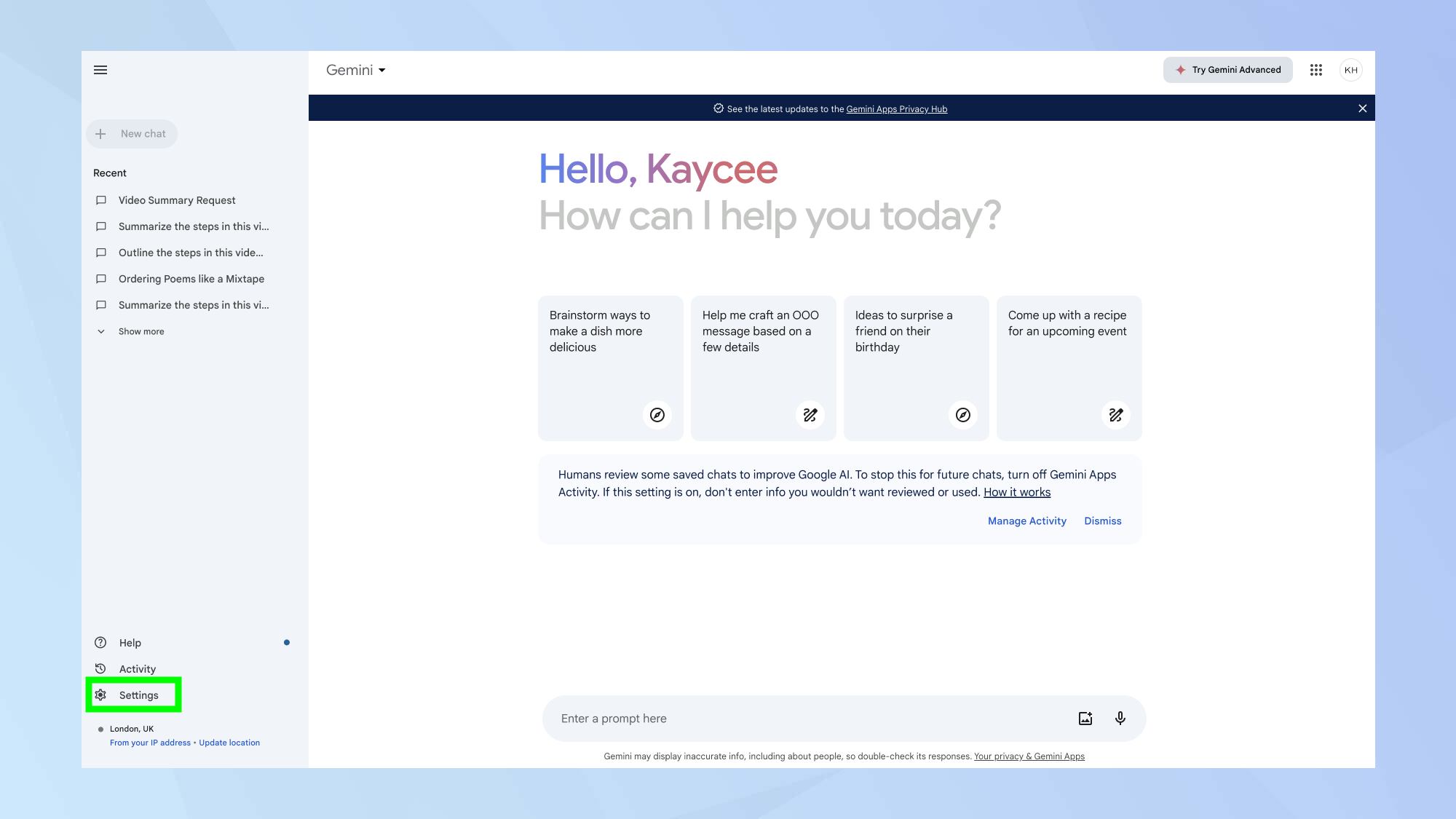

برای کسانی که هنوز آن را امتحان نکردهاند، Gemini Personal Intelligence یک ویژگی است که برای استفاده از تاریخچه، تنظیمات برگزیده و حتی Gmail، Google Docs و Google Photos شما برای ارائه پاسخهای متناسبتر طراحی شده است.

مفید به نظر می رسید. در عمل باعث حواس پرتی شد و بیشتر از بهره وری مشکلات ایجاد کرد. پس از مدتی استفاده از آن، متوجه الگویی شدم: Gemini متن شخصی را به پاسخ هایی می کشاند که به آن تعلق نداشت. برای همین بالاخره گوشی را قطع کردم.

ادامه مقاله در زیر

این یک خطای حریم خصوصی نبود. این یک خطای عملکرد بود

یکی از دلایلی که کاربران هوش مصنوعی حالت هوش شخصی و حافظه را غیرفعال می کنند این است که نگران این هستند که هوش مصنوعی بتواند به همه چیز از ایمیل گرفته تا فایل دسترسی داشته باشد. بیشتر انتقادات از هوش مصنوعی شخصیشده بر جمعآوری دادهها یا نگرانیهای حفظ حریم خصوصی متمرکز است. اینها معتبر هستند، اما در تجربه من این به هیچ وجه مربوط به یک باگ حریم خصوصی نبود، این روش هوش شخصی برای بدتر کردن همه پاسخهای من بود.

نکته جالب این است که من متوجه نشدم که چقدر پاسخها بد بود تا زمانی که آنها را با حساب Gemini خود مقایسه کردم، که از هوش شخصی استفاده نمیکند. بسته به اینکه در کامپیوتر شخصی یا کاری بودم، جمینی را باز می کردم و سوالی می پرسیدم. وقتی از حساب شخصیام مرتبط با هوش شخصی استفاده کردم، موردی اضافه شد که قرار نبود آنجا باشد.

برای مثال، اگر به دنبال دستور غذای مرغ برای شام بودم، میتوانم چیزی شبیه این بگویم: «از آنجایی که شما کتاب Nico IRL خود را در نمایشگاه کتاب در سپتامبر امسال تبلیغ میکنید، میخواهید با چنین دستورهایی در زمان خود صرفهجویی کنید».

ها؟ به عبارت دیگر، من یک سوال منظم و نامربوط میپرسیدم، و جمینی به مکالمات قبلی برمیگشت و سعی میکرد نقاطی را که نیازی به اتصال ندارند به هم وصل کند. او گاهی اوقات بیش از حد به جای پاسخ دادن به سؤالی که در مقابلش قرار داشت، بیش از حد روی اثبات اینکه چقدر به یاد دارد متمرکز می شد.

این فقط یک بار اتفاق نیفتاد، تقریباً هر بار اتفاق افتاد تا اینکه در نهایت “آن را دریافت کردم” و آن را خاموش کردم.

این اطلاعات نبود، یک قطعی بود

جنبه حافظه در Gemini عالی است، تا زمانی که اینطور نباشد. من از ارائه اطلاعات خاص قدردانی می کنم، اما برای انجام این کار همیشه به هوش مصنوعی نیازی ندارم. به نظر من، حافظه اصلاً اینطور کار نمی کند.

به عنوان مثال، با ChatGPT، چیزی مانند این را میپرسم: “به یاد داشته باشید که آن زمان از شما درخواست کردم که به من کمک کنید تا نامه ای آرام برای معلم فرزندم بنویسم؟ بیایید آن را برای یک حادثه مرتبط دیگر بررسی کنیم.”

ChatGPT در صورت درخواست آن را بالا می کشد و سعی نمی کند وقتی چیز دیگری درخواست می کنم آن را دور بیندازد. این نقطه شکست برای جمینی و من بود. پاسخ ها به شدت بی اساس به نظر می رسید. تصور کنید که یک دستور غذای ساده یا یک ایده سریع می خواهید و چیزی شبیه به این دریافت می کنید:

من می دانم که شما در حال نوشتن کتاب علمی تخیلی دیگری هستید، بنابراین در اینجا یادداشتی برای معلم فرزندتان وجود دارد که ممکن است بخواهید آن را در کتاب بگذارید.

بدیهی است که این بیانیه دقیق نیست، اما موضوع را کاملاً درک می کند. زمینه گذشته برای یک پروژه کتاب ربطی به کار در دست نداشت. مثل صحبت کردن با کسی بود که به جای کمک کردن، نیمه گوش کرد، سپس موضوع را به چیزی تصادفی تغییر داد که در مورد شما به یاد آورد.

نتیجه پاسخ های هوشمندانه تری نبود. آنها کثیف بودند. برای من یک شخصی سازی خوب باید بداند چه زمانی باید ساکت بماند و آنچه را که به خاطر می آورد در زمان مناسب مطرح کند.

وقتی حالت حافظه مفید است

حافظه زمانی که از پروژه شما پشتیبانی می کند می تواند واقعا مفید باشد. به عنوان مثال، داشتن هوش مصنوعی لحن نوشتن دلخواه، کارهای تکراری، عادات قالببندی، شغل، ویژگیهای شخصیت یا ابزارهای مورد علاقهتان میتواند به شما کمک کند از یادآوری مداوم این موارد به هوش مصنوعی خودداری کنید.

همه اینها در وقت من صرفه جویی زیادی کرد. اما دستیاران بزرگ نیز به قضاوت نیاز دارند. آنها باید بدانند که چه زمانی بافت گذشته مهم است و چه زمانی باید در پس زمینه باقی بماند. اینجاست که این تجربه کوتاه می آید. متوجه شدم که دقت دستورالعملهای ویژه وجود ندارد، جایی که به جای اینکه به هوش مصنوعی اجازه بدهم بر اساس همه چیزهایی که قبلاً گفته بودم حدس بزند، آنچه را که هوش مصنوعی میدانست انتخاب کردم.

بعد از تعطیلی چه چیزی تغییر کرد؟

وقتی هوش شخصی را غیرفعال کردم، پاسخها تقریباً بلافاصله از طریق پاک کننده دریافت شد. جمینی بیشتر بر تقاضای فعلی متمرکز بود. او تلاش برای اضافه کردن جزئیات قدیمی از مکالمات نامرتبط را متوقف کرد. طوفان فکری کمتر قاببندی شده بود و سوالات ساده پاسخهای مستقیم دریافت کردند.

مهمتر از همه، دیگر احساس نمی کردم که باید حافظه هوش مصنوعی را “مدیریت” کنم. برای جلوگیری از ایجاد یک خاطره قدیمی، مجبور نبودم دستورات را با دقت بیان کنم. فقط تونستم بپرسم

اما من فکر می کنم در اینجا درس بزرگتری برای ابزارهای هوش مصنوعی وجود دارد. این ایده به ما تلقین شده است که حافظه بیشتر یک ارتقای خودکار است و شخصی سازی بیشتر و زمینه بیشتر به معنای ارتباط بیشتر است.

اما زمینه بیشتر تنها زمانی کمک می کند که با آگاهی اجتماعی به کار رود. در غیر این صورت، یک مشکل جدید عجیب به وجود می آید: دستیار هوش مصنوعی که همه چیز را در مورد شما می داند اما نمی داند در حال حاضر چه چیزی مهم است.

در نتیجه

من میخواستم Gemini Personal Intelligence دستیار را تیزتر کند. در عوض، در جایی که باید وضوح وجود داشته باشد، نویز ایجاد کرد. در مورد حالت حافظه، من حافظه ChatGPT را نگه می دارم اما در Gemini آن را کاملاً خاموش می کنم. نکته مهم در اینجا این است که بهترین هوش مصنوعی نباید فقط همه چیز را به خاطر بسپارد. او باید این خرد را داشته باشد که به خاطر بیاورد که چه زمانی آن را ذکر کند و زمینه ای برای مطرح نکردن آن ناخواسته داشته باشد. خاموشش کردم و راستش را از دست ندادم.

دنبال کردن راهنمای تام برای Google News و ما را به عنوان منبع ترجیحی اضافه کنید برای مشاهده آخرین اخبار، تحلیل ها و بررسی های ما در فیدهای خود.