نه ، سیمپسونها حدس نمی زنند – در اینجا چگونه AI فریب ویروسی را تغذیه می کند (و چگونه آنها را تشخیص دهیم)

من اشاره کردم که کلاهبرداران هوش مصنوعی بدتر می شوند ، اما من اخیراً الگوی دیگری را متوجه شده ام: فریب ویروسی بیشتر اوقات است و آنها سریعتر از همیشه گسترش می یابند.

دو مثال آخر ادعا می کنند که “سیمپسونها” روشی عجیب و غریب از رویدادهای ویژه مانند رسوایی شیشه بوسه یا مگاکیک 5 ژوئیه در ژاپن را پیش بینی می کند.

اما وقتی بیشتر نگاه می کنم ، این “پیش بینی ها” با تصاویر و کلیپ هایی که احساس درستی ندارند مطابقت داشتند. زیرا بیشتر فریب های ویروسی امروز اغراق آمیز نبودند. در حقیقت ، تصاویر ایجاد شده توسط هوش مصنوعی توسط کلیپ های ویدیویی جعلی و دندانهای عمیق که برای گمراه کننده طراحی شده اند ، ایجاد شده اند.

با کمال تعجب ، هوش مصنوعی می تواند در ضمن سوختن برخی از قانع کننده ترین فریب هایی که تاکنون دیده ایم ، به آشکار کردن حقیقت کمک کند.

هوش مصنوعی با خواسته های مناسب ، ابزار و برخی از کارآگاهان دیجیتال ، می تواند یک جعلی ویروسی را معکوس کند. تماشای ریشه های خود ، تجزیه و تحلیل سرنخ های بصری و گرفتن محتوا متقاطع در سراسر وب.

در اینجا حق استفاده از ابزارهای AI یا چیزی که می توانید به صورت آنلاین مشاهده کنید برای بررسی فریب اینترنت و رها کردن بالقوه است.

هر وسیله نقلیه هدف متفاوتی را ارائه می دهد و می تواند به شما در تعیین آنچه واقعی و جعلی است کمک کند.

chatgpt برای کنترل واقعی

همانطور که به نظر می رسد طعنه آمیز است ، در صورت درخواست صحیح ، چتپ به طور شگفت آور برای کنترل واقعی خوب است.

تجزیه و تحلیل متنی ، مقایسه های تاریخی و منطق افسانه ای را می توان با Chatgpt انجام داد ، زیرا می تواند یک اطلاعات متقاطع را ایجاد کند ، ناسازگاری ها را علامت گذاری کند و توضیح دهد که حتی اگر یک ادعا نباشد ، حتی اگر اینگونه نباشد.

من با ترک ادعای ویروسی برای چتپ با درخواست شروع کردم: “آیا سیمپسون ها واقعاً رسوایی شیشه بوسه را پیش بینی کرده اند؟”

Chatgpt بخش (NO) را مشخص کرد ، توضیح داد که چرا این ادعا می تواند آشنا به نظر برسد (با الهام از یک سینه قدیمی) و زمینه ای قابل اعتماد برای رد افسانه فراهم کرد.

اگرچه مشخص کردن منبع ChatGPT بسیار خوب است ، می توانید از شما بپرسید که همیشه منابع مشخص شده را ندیده اید.

فقط از منبع بپرسید و از آن بخواهید. حتی می توانید بپرسید مانند دنبال کردن ، “فریب گسترده حاوی پیش بینی های سیمپسون چیست؟” برای آشکار کردن الگوهای ، تاکتیک های دستکاری و اینکه چرا برخی از شایعات ویروسی می شوند.

تعجب برای تحقیق

غافلگیر کننده یک منبع عالی است که می توان از نظارت بر مواد جوشکاری و اتصال به مقالات واقعی ، نخ های Reddit یا انتشارات بایگانی شده استفاده کرد.

از ویدیوی ویروسی تا حیرت عنوان یا نقل قول را شروع کنید و از AI با چیزی شبیه به این درخواست کنید: “این ادعا از کجا آمده است؟”

معمولاً تاریخ پخش کامل و پاسخ های پشتیبانی شده را دریافت خواهید کرد. این برای تماشای چگونگی پخش گسترده (و سریع) فریب است.

حالت “Copilot” را برای شیرجه های عمیق تر با پاسخ های مبتنی بر استناد بیشتر تغییر دهید.

اگر از افسانه لذت می برید و قصد دارید این کار را مرتباً انجام دهید ، زمینه های حیرت را امتحان کنید. شما می توانید با اضافه کردن مراحل مانند “شناسایی نوع منبع” ، “تاریخ کنترل و مبدا” یا “خروجی های قابل اعتماد” ، از این الگوهای منطقه کاری تعیین شده استفاده کنید و مراحل را برای فریب تطبیق دهید.

در این مرحله ، می توانید تماس های وب و همچنین مواد مرجع را نصب کنید (به عنوان مثال ، گزارش های کنترل واقعی ، بیانیه های رسمی).

استفاده از این زمینه به شما امکان می دهد دستورالعمل های ویژه AI را ایجاد کنید ، تا همیشه بتوانید منابع را بررسی کنید یا هر بار بر ناسازگاری ها تأکید کنید.

تشخیص تصویر معکوس با لنز Google

آیا هنگام پیمایش تصویری نامرئی می بینید؟ شما می توانید chatGPT را نصب کنید و از او بپرسید که آیا AI ایجاد شده است ، اما لنز Google کمی بیشتر آن را خواهد گرفت.

اگر از اثبات یک عکس مطمئن نیستید ، از تصویر تصویر ویروسی یا تصاویر کوچک ویدیویی عکس بگیرید و آن را روی لنزهای Google نصب کنید.

سپس چیزی شبیه به این را بپرسید: “این تصویر به صورت آنلاین به نظر می رسد؟”

یا “آیا این عکس واقعی است یا هوش مصنوعی؟”

می توانید کشف کنید که از یک سایت تصویر سهام خارج شده یا از یک سینه قدیمی با پرچم قرمز باز تغییر کرده است.

دستگاه بازپرداخت

دستگاه Wayback در واقع ماشین زمان اینترنت است. خوب است بررسی کنید که آیا مقالات یا وب سایت ها بی سر و صدا پس از ویروسی ویرایش می شوند.

اگرچه این یک ابزار هوش مصنوعی نیست ، می توانید URL را به Archive.org وصل کنید تا تصاویر فوری قدیمی را مقایسه کنید.

از آنجا می توانید کشف کنید که جزئیات تغییر یافته ، اضافه یا حذف شده و هنگام جلب توجه ، تصویر یا فیلم ویروسی می شود.

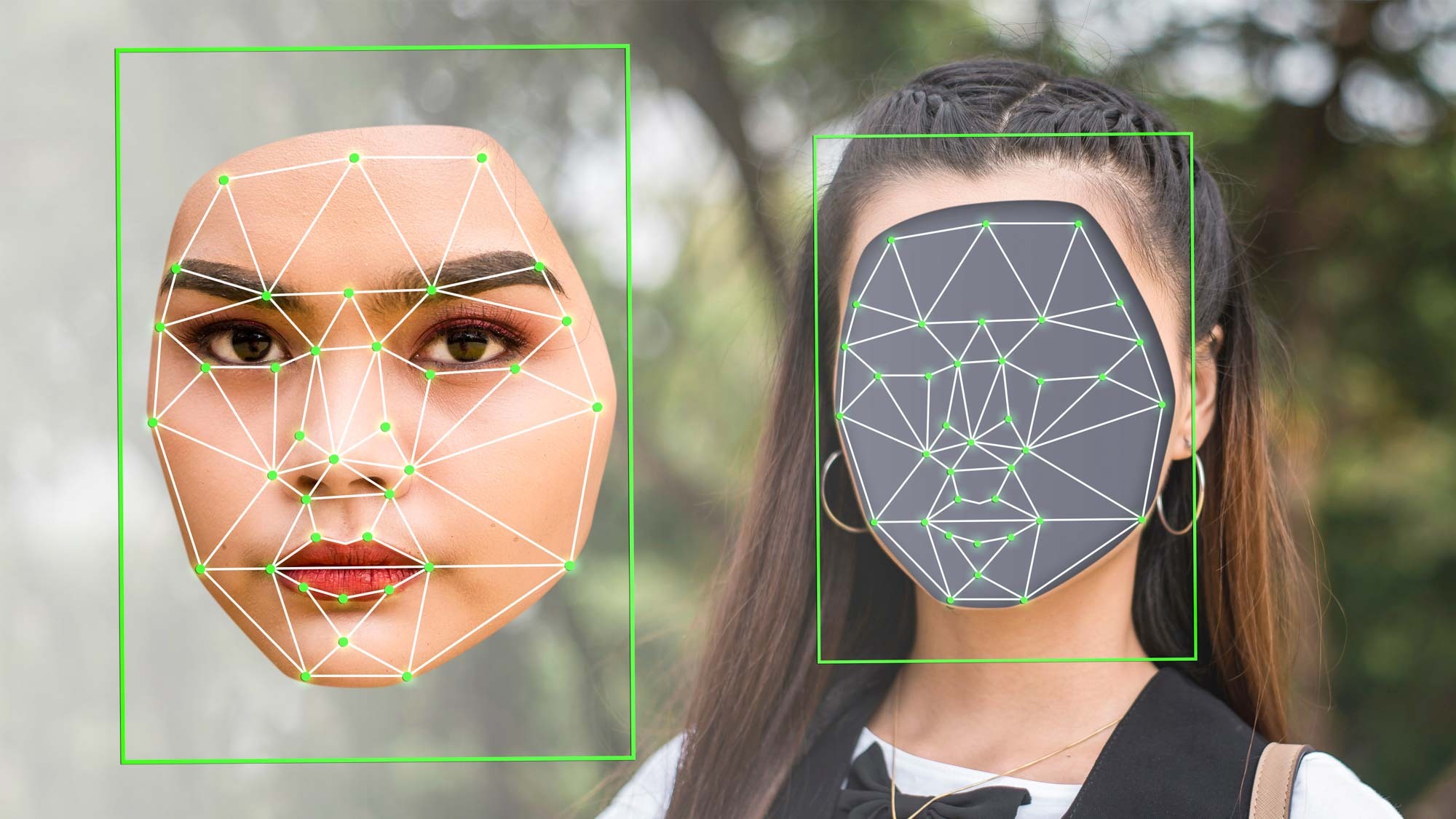

Hive یا Deption AI: تشخیص تأسیسات عمیق

در تصاویر و نوشتن ، ما در مورد چگونگی شناسایی هوش مصنوعی بحث کرده ایم و این دو سایت برای آن مفید هستند.

می توانید کلیپ یا قاب را در یکی از این سیستم عامل ها بارگذاری کنید. ابزار AI محتوای علائم دستکاری هوش مصنوعی را تجزیه و تحلیل می کند. این به ویژه برای چهره ها یا صداهای جعلی مفید است.

وسایل نقلیه پرچم های قرمز مانند حرکات لب بدون تطبیق ، نورپردازی عجیب و یا چشمک زدن متناقض را اسکن می کنند. تمام نشانه هایی که ممکن است این فیلم توسط AI تولید یا اصلاح شود.

آخرین افکار

فریب هوش مصنوعی هر روز ویروسی می شود و تشخیص آن تا چند دقیقه دشوار می شود.

با این حال ، دانستن چگونگی استفاده از هوش مصنوعی برای کمک به مبارزه با سوء تفاهم ها به این معنی است که همه می توانند یک میتبوستر دیجیتالی باشند.

به عمق منشاء خود ، سرگرم کننده ، تقویت شده و من می گویم شکل گیری عادت می گویم. به من نگو من به شما هشدار نمی دهم زیرا خودتان را در حال پایین آمدن از دنده های کلاهبرداری جدی خواهید دید.

بنابراین اکنون ، در کنار شما یک Tiktok مشکوک یا تعجب می کند که چرا “سیمپسونها” یک روند است. دوبارههوش مصنوعی می تواند به شما در جدا کردن حقیقت از داستان کمک کند.

دنبال کردن راهنمای تام در Google News در انتشارات خود برای به دست آوردن اخبار روزانه ما ، چگونه TOS و بررسی ها. حتماً روی دکمه ردیابی کلیک کنید.

بیشتر از راهنمای تام

بازگشت به لپ تاپ ها